众所周知,深度学习是人工智能技术的中心卖点:经过模仿人脑机制,机器也可以像人那样,自主学习海量深邃的知识,从而取得常人无法企及的技艺,协助人类完成更为曼妙和科幻的场景。不过,神往虽然美妙,但是随着一批深度学习使用逐步开端变成理想,平安成绩也渐渐显现出来。

日前,360平安研讨院结合过来一年对深度学习零碎平安性的详细研讨,出具了《AI平安风险白皮书》。白皮书从深度学习零碎软件完成的复杂度、深度学习零碎模型的逃逸攻击和深度学习零碎数据流中的平安要挟三个角度,详细解读了AI零碎的平安要挟。

以后人工智能使用面临多方要挟

2017年以来,每次有关人工智能的旧事报道都会让很多网友由衷的感慨。比方谷歌AlphaGo与李世石、柯洁等国际一流围棋巨匠对弈,将这些围棋一流好手“挑落马下”。像围棋这种复杂多变的棋盘 游戏 ,简直代表了人类的顶级智慧。AlphaGo可以在千变万化的棋局中,选择对本人更为有利的步数,继而博得棋局,靠的便是深度学习算法对场上形势停止研判。

不过,像AlphaGo这样的人工智能使用并不与外界有直接的交互,或许是在封锁的环境下任务,因而遭到的平安要挟绝对较小。但是,随着人工智能使用的普及,平安要挟会不时添加,更多的使用会把使用的输出接口直接或直接暴显露来。同时封锁零碎的攻击面也会随着工夫和环境而转化。

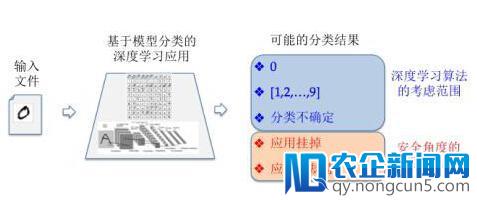

图1:深度学习算法与平安所思索的不同输入场景很多朋友说,共享纸巾机是一个广告机,但我们不是这样定义它,我们定义它是一个互联网跟物联网结合的终端机,从线下吸入流量,重新回到线上,以共享纸巾项目作为流量入口,打造全国物联网社交共享大平台。

目前大众对人工智能的关注,尤其是深度学习方面,短少对平安的思索,这是人工智能平安的“盲点”,近期很多关于深度学习的讨论次要停留在算法和前景瞻望的层面,并没有思索人为歹意形成或分解的场景;深度学习软件层面,很多是完成在深度学习框架上。但是零碎越是复杂,就越是能够包括平安隐患。任何在深度学习框架以及他所依赖的组件中的平安成绩都会要挟到框架之上的使用零碎;另外,正如平安人员常说的,魔鬼往往隐藏于细节之中,任何一个大型软件零碎都会有时限破绽。思索到深度学习框架的复杂性,深度学习使用也不例外。

深度学习逃逸攻击让AI零碎迷了眼睛

同时,白皮书以逃逸攻击为例,解析了深度学习模型所存在的一些平安成绩。所谓逃逸攻击,指的是攻击者在不改动目的机器学习零碎的状况下,经过结构特定的输出样本以完成诈骗目的零碎的攻击。只需一个机器学习模型没有完满学到判别规则,攻击者就有能够结构对立样本以诈骗机器学习零碎。

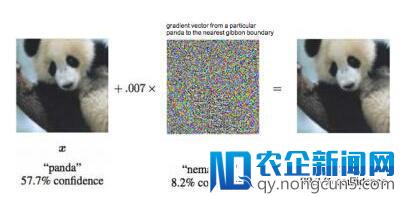

图2:稍加搅扰要素 深度学习零碎会将熊猫误以为长臂猿

白皮书中罗列了Ian Goodfellow在2015年ICLR会议上提出的著名逃逸样本,样本运用了谷歌的深度学习研讨零碎,该零碎应用卷积神经元网络,可以准确区分熊猫和长臂猿等图片。

不过,攻击者对熊猫的图片“稍加改造”,增添了一些搅扰要素。虽然这纤细的差异并不会影响人类的判别,不过深度学习零碎却把熊猫误以为了长臂猿。试想在具有图像辨认功用的AI零碎中,假如判别失误,AI零碎就很有能够做出一模一样的选择,有能够招致十分严重的结果。

此外,基于机器学习的逃逸攻击次要是分为白盒攻击和黑盒攻击。白盒攻击需求获取机器学习模型外部的一切信息,然后直接计算失掉对立样本;黑盒攻击则只需求晓得模型的输出和输入,经过察看模型输入的变化来生成对立样本。

深度学习需慎重降维攻击

此外白皮书指出,在深度学习的数据处置流程中,异样存在平安风险。攻击者在不应用平台软件完成破绽或机器学习模型弱点的状况下,只应用深度学习数据流中的处置成绩,就可以完成逃逸或许数据净化攻击。

图3:降维处置能够招致深度学习零碎“指鹿为马”

比方,白皮书援用了Caffe平台自带的经典图片辨认使用案例,案例运用了一张羊群的图片,辨认所用的神经元网络是谷歌发布的GoogleNet,数据来自著名的ImageNet竞赛。不过令人遗憾的是,Caffe的深度学习使用将羊群误判为狼。究其缘由,还是由于深度学习本身算法的成绩。由于深度学习模型真正用到的数据都会是维度变化过的图片,即对图片停止了一些算法处置,其中包括最近点抽取、双线性插值。这些处置的目的就是降低算法的复杂水平,并尽量坚持图片原有的样子。

但是这些常用的降维算法并没有思索歹意结构的输出。下面的攻击例子,则是针对最常用的双线性插值结构的歹意攻击样本。依据白皮书的初步剖析,简直一切网下流行的深度学习图片辨认顺序都有被降维攻击的风险。关于降维攻击的防备,用户可以采用对超出异常的图片停止过滤,对降维前后的图片停止比对,以及采用愈加强健的降维算法等。

以后,人工智能的风潮席卷而来,人们醉心于新颖事物带来的全新体验,却往往无视了暗流涌动的平安成绩。随着人工智能的普及,人工智能将面临来自多个方面的要挟:包括深度学习框架中的软件辨认破绽、对立机器学习的歹意样本生成、训练数据的净化等等。将来,作为国际最大的网络平安公司,360将以更为开放、分享的心态,努力于协助行业及厂商处理人工智能的平安成绩,为我国人工智能的蓬勃开展保驾护航。