选自Berkeley Lab

机器之心编译

参与:李诗萌、刘晓坤

机器学习模型通常依赖于少量训练数据,所以在很多范畴中难以发挥拳脚。近日,伯克利实验室 CAMERA 的研讨人员开发了十分高效的卷积神经网络,可以从无限的训练数据中剖析实验迷信图像,准确地执行图像联系和图像去噪等,并无望扩展到其它实验研讨范畴中。

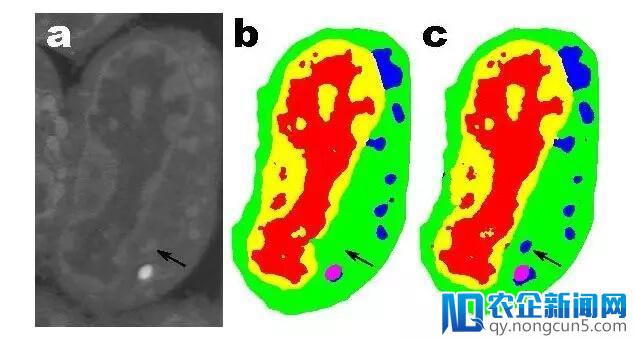

小鼠淋巴母细胞的切片。(a)原始图像;(b)人工切割失掉的切片;(c)100 层的 MS-D 网络的输入(数据来自 A.Ekman, C. Larabell, National Center for X-ray Tomography)

动力部劳伦斯伯克利国度实验室(Berkeley Lab)的数学家们开发了一种针对实验性成像数据的新的机器学习办法。这种新办法不像典型的机器学习办法一样需求数万或数十万张图像用于训练——它可以在运用更少的图像的同时,更快地停止学习。

伯克利实验室的 CAMERA(动力初级数学研讨与使用中心,Center for Advanced Mathematics for Energy Research Applications)的 Daniël Pelt 和 James Sethian 开发了一种新算法,他们将这种算法称为「多尺度密集卷积神经网络」(MS-D,Mixed-Scale Dense Convolution Neural Network)。这种新办法与传统办法相比,需求的参数更少,收敛得也更快,而且可以基于相当小的训练集停止「学习」。这种办法已用于从细胞图像中提取生物构造,还计划为多个研讨范畴提供新的数据剖析的计算工具。

随着实验设备可以更快地发生更高分辨率的图像,迷信家们能够难以经过人工方式对发生数据停止管理和剖析。2014 年,Sethian 在伯克利实验室成立了 CAMERA。CAMERA 是一个集成了许多穿插学科的中心,成立目的在于开发美国动力部迷信用户设备办公室的实验探究所需的根底数学办法。CAMERA 是该实验室计算研讨部门的一局部。

Sethian 同时也是 UC Berkeley 的数学教授,他以为:「在迷信使用中,需求少量人力对实验图像停止正文和标志——能够需求几周才干失掉一些批注过的图像。我们的目的是开发一项可以经过很小的数据集停止学习的新技术。」

该算法的相关论文宣布于 2017 年 12 月 26 日的美国国度迷信院院刊上(见文末)。

Pelt 是荷兰数学与计算迷信研讨所上司的计算成像小组的成员,他引见说:「这项打破源于我们认识到,不同图像尺度的特征提取的缩放运算,可以用能处置多个尺度的数学卷积的一层所替代。」

为了失掉更普遍的使用,Olivia Jain 和 Simon Mo 指导的伯克利团队树立了门户网站「图像数据标志引擎(SlideCAM,Segmenting Labeled Image Data Engine)」

该算法还可用于了解生物细胞外部构造,这一使用也十分有前景。运用 Pelt 和 Sethian 的 MS-D 办法,仅需求七个细胞的数据,就可确定该细胞的外部构造。

国度 X 射线断层成像中心主任、加利福尼亚大学旧金山医学院的教授 Carolyn Larabell 说:「我们实验室中的次要任务是理解细胞的形状构造是如何影响和控制细胞行为的。我们破费有数小时手动联系细胞,以提取细胞构造并辨认细胞间的差别,如辨认安康细胞和病变细胞间的差别。新算法能够彻底改动我们对疾病的认知才能,而这种算法也是绘制人类细胞图谱的次要工具,绘制人类细胞图谱是扎克伯格和他的夫人资助的一项全球协作项目,旨在绘制出安康人体中一切的细胞。」

国度 X 射线断层成像中心位于 ALS(Advanced Light Source,先进光源实验室),伯克利实验室的美国动力部迷信用户设备办公室。

从更多数据中取得更多迷信

图像无处不在。智能手机和传感器曾经发生了少量的图片,这些图片中曾经有很多标明了图片内容的相关信息。经过庞大的穿插参考图像的数据库,卷积神经网络和其他机器学习算法曾经彻底改动了我们疾速辨认自然图像的才能(相似于已经见过和分类过的图像)。

这些办法需求数以百万标志过的图像数据,需求运用超级计算机破费少量的工夫停止训练,还需求调整一系列隐藏的外部参数停止「学习」。但是假如没有那么多标志过的图像呢?在许多范畴,想要这样的数据集都是一个朴素的愿望。生物学家记载下细胞图像,手动标志出细胞的边界和构造:对他们而言,为失掉一个完好独立的细胞的三维构造而破费好几周是一件稀松往常的事情。资料学家应用断层重建技术对岩石和资料停止比照,手动对不同区域停止标志,识别出裂痕、断口和空隙。不同但重要的构造间的差别往往都会十分小,而数据中的噪声会将特征粉饰起来,并会使最好的算法以及人类发生混杂。

关于传统的机器学习办法而言,这些珍贵的手工标志的图像远远不够。为了迎接这一应战,CAMERA 的数学家们用十分无限的数据处理了这一成绩。为了用更低的本钱取得更高的收益,他们的目的是树立一组高效的数学「算符」,可以大规模增加参数数量。这些数学算符能够会与关键的约束条件结合,以协助计算机对图像停止辨认,例如要求外形和形式在迷信上合理。

多尺度密集卷积神经网络

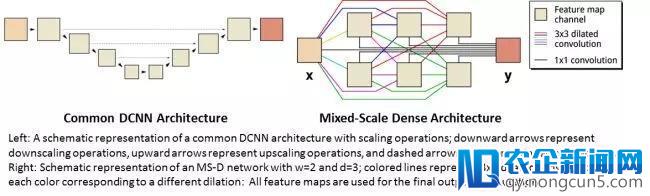

机器学习在图像成绩上的使用大多运用的是深层卷积神经网络(DCNNs,deep convolutional neural networks)。在 DCNN 中,输出图和两头图在许多延续的层中停止卷积,使得网络可以学到高度非线性特征。为了在困难的图像处置成绩中失掉准确的后果,DCNN 通常会依赖一些其他操作,这些操作包括但不限于对图像停止缩放以在不同尺度上提取特征。为了训练更深层更弱小的网络,通常会需求添加更多的层类型和衔接。最终,DCNN 会运用少量的两头图和可训练的参数(普通会超越一亿)来处理复杂的成绩。

相反,新的「MS-D」网络架构防止了这些复杂的成绩。它用扩张卷积替代缩放操作以捕获不同空间范围的特征,在单个层中执行多个尺度的特征提取运算,并将一切的两头图密集地衔接起来。新算法只需求很少的两头图和参数就能失掉精准的后果,既不需求调整超参数也无需额定的层和衔接停止训练。

左图:普通的 DCNN 架构。具有缩放操作的普通 DCNN 架构的简图;向下的箭头代表减少操作,向上的箭头代表缩小操作,短箭头代表跳过衔接。右图:MS-D 架构。W = 2、d = 3 的 MS-D 网络的草图。带颜色的线表示 3*3 的扩张卷积,每一个颜色都代表不同的扩张操作;一切的特征映射都用于最终的计算输入。

从低分辨率数据中取得高准确度的后果

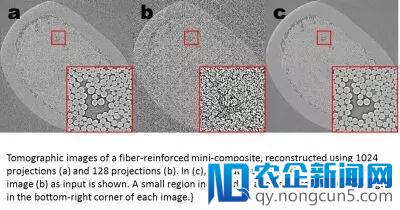

另一项应战在于如何从低分辨率的输出发生高分辨率的输入。任何一个试图将一张小照片缩小的人都会发现,随着照片越来越大,图片会变的越来越模糊,因而要完成这一应战听起来简直是不能够的。但是用 MS-D 网络处置大批的训练图像的确可以获得一些实践的停顿。例如,对纤维加强的微型复合资料的层析重建进程停止降噪。在文献中提到的实验,运用 1024 个 x 射线投影重建的图像失掉的图像噪声绝对较低。再运用 128 个投影重建,来取得同一个对象的噪声图像。训练的输出是有噪声的图像,在训练中将无噪声的图像作为目的输入。经过训练的网络可以高效地运用有噪声的输出重建高分辨率的输入图。

纤维加强的微星复合资料的断层图,运用 1024 个投影重建失掉(a), 运用 128 个投影重建失掉(b)。用(b)作为 MS-D 网络的输出失掉的输入是(c)。每张图白色方框标出的小区域缩小后出现在每幅图的右下角。

新的使用

Pelt 和 Sethian 正在将他们的办法使用于许多新的范畴,例如对来自同步减速器光源的图像停止疾速实时的剖析,以及生物范畴的重建成绩,例如细胞和大脑的映射。

Pelt 以为:「这些新办法都很令人振奋,由于它们让机器学习处理更普遍的成像成绩成为能够。经过增加需求的训练图的数量以及添加可处置图像的尺寸,这个新的网络架构可在许多研讨范畴处理更重要的成绩。」

劳伦斯伯克利国度实验室努力于经过推进可继续动力、维护人类安康、发明新资料以及提醒宇宙来源与命运,处理世界面临最紧迫的成绩。成立于 1931 年的伯克利实验室已取得 13 项诺贝尔奖。实验室由加利福尼亚大学管理,由美国动力部迷信办公室担任。

论文: A mixed-scale dense convolutional neural network for image analysis (多尺度密集卷积神经网络用于图像剖析)

论文链接:http://docs.wixstatic.com/ugd/cc66e4_bb1cd44c5f354517bb3f7b8c1db45cc4.pdf

摘要: 在最近的任务中,深度卷积神经网络已成功处理了许多图像处置成绩。当下运用的网络架构通常会在规范架构中添加额定的操作和衔接,以训练更深层的网络。为了在实践使用中失掉更高的精确率,就需求更多的可训练参数。在此,我们引见的网络架构,是在不同的图像尺度中经过扩张卷积以捕获特征,并将一切特征图密集衔接。新架构可以在运用大批参数和运用一组操作的前提下,进步后果的精确率,使得网络更易在实践中施行、训练和使用,且可适用于不同的成绩。我们在几个联系成绩中对现有架构和新架构停止了比拟,后果标明本文提出的架构可以在运用更少参数、更大水平地防止与训练数据过拟合的状况下,取得精确率更高的后果。

原文链接: http://newscenter.lbl.gov/2018/02/21/new-berkeley-lab-algorithms-create-minimalist-machine-learning-that-analyzes-images-from-very-little-information/