原作 TAYLOR KUBOTA

Root 编译自 Stanford News

量子位 报道 | 大众号 QbitAI

拐角路口没有装凸面反光镜的话。

△ 没找凸面反光镜了……就是没有

老司机开车都得加速慢上去。

谁晓得拐弯看不见的中央,会不会有人或小植物忽然窜出来。

就更别说无人车了。

辣有没有能够,现有的激光雷达可以 提早看到视域外的物体 ,及时启动制动功用?

斯坦福SCIL实验室在努力

完全有。

在昨天,3月5号,斯坦福SCIL实验室(Stanford Computational Imaging Lab)在Nature上宣布了一篇论文, Confocal Non-line-of-sight Imaging based on the Light-cone Transform 。

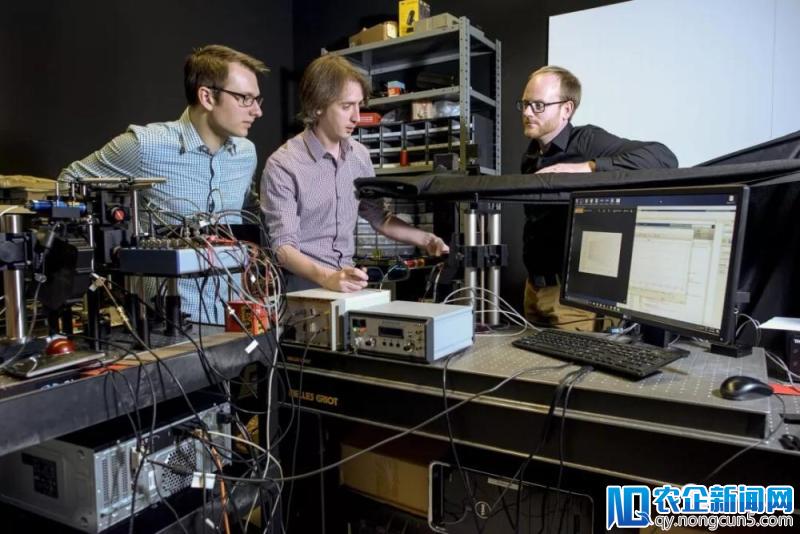

△ “透视”零碎研发团队:David Lindell(左)、Matt O’Tool移动互联网在带来全新社交体验的同时,也或多或少使人们产生了依赖。移动互联网使网络、智能终端、数字技术等新技术得到整合,建立了新的产业生态链,催生全新文化产业形态。e(中)、助理教授Gordon Wetstein(右)

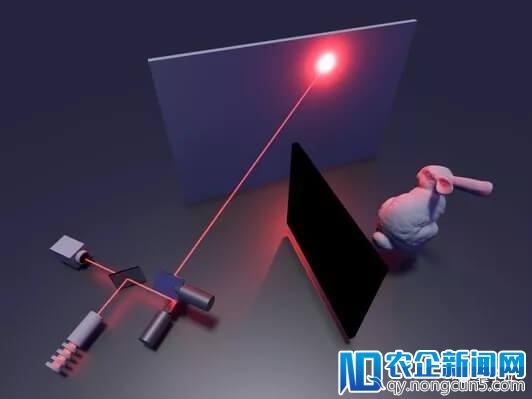

这篇文章,论述了如何应用反射回来的光束3D建模复原出拐角盲区后的物体。

他们研发这个“透视”技术的初衷,是想用在无人车上,提早预判出拐角的人,添加无人驾驶的平安性。

△ 斯坦福的小哥哥们研发设计了一个基于激光的零碎,可以对视域外的物体成像。

“听起来很神奇,但这是可以完成的。”斯坦福电子工程助理教授Gordon Wetstein说。

“看见”看不见的

坦白地讲,这个借用激光的反射把拐角盲区的物体成像的办法,并不是只要斯坦福研讨团队在做。

不过,他们的算法最好用。

算法原理引见视频传送⤵

“盲区物体成像的应战,是找出一种无效的办法来从噪声测量中恢复看不见物体的三维构造,”SCIL实验室研讨生David Lindell说。 “我以为,这种办法能有多大的影响力,取决于成像的计算效率。”

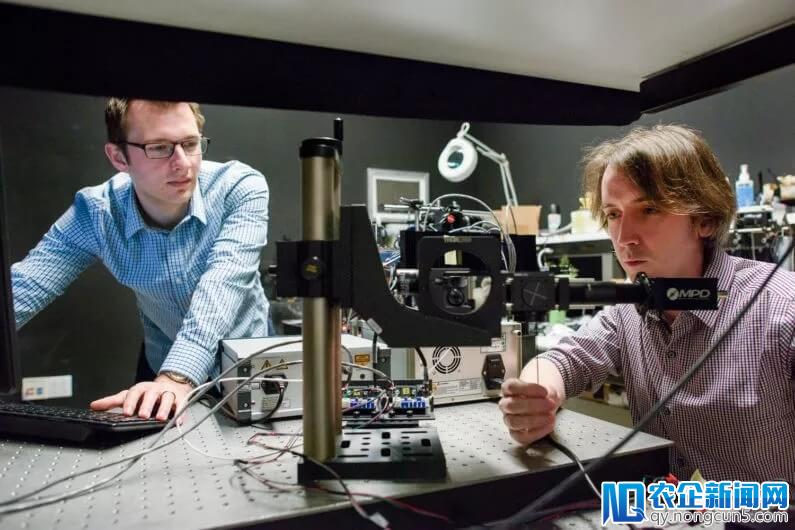

△ 该论文的作者博士后Matt O’Toole(右)和研讨生David Lindell

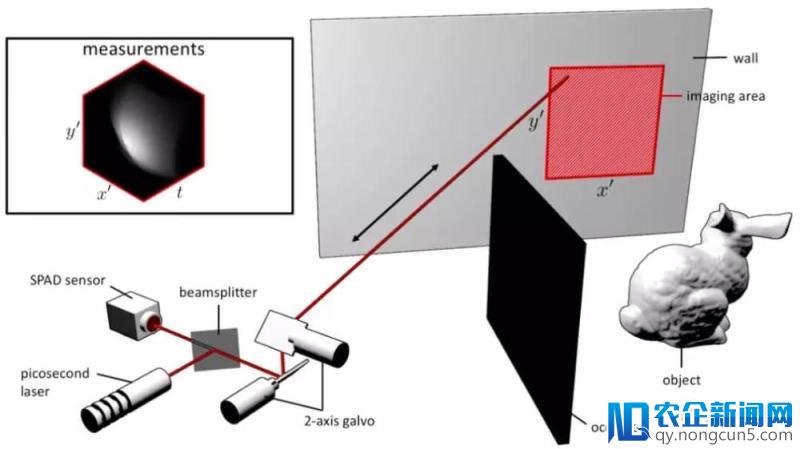

这套零碎,研讨团队把一个激光器放在了一个光子探测器旁边。

在互联网思维的影响下,传统服务业不再局限于规模效益,加强对市场的反应速度成为传统服务业发展的首要选择。在互联网思维下,通过对传统服务业的改革,为传统服务业发展创造了全新的天地。

这个探测器高度敏感,可以捕获到单个光粒子。

研讨团队往墙上打人肉眼看不到的激光脉冲,然后这些脉冲遇到拐角面前的物体,会反弹回到墙下去,继而被光子探测器接纳。

现阶段,扫描的进程能够需求两分钟到一小时,详细取决于光照条件和盲区物体的反射率。

一旦扫描完成后,算法会计算回收光子的轨迹,逐步把模糊的点变成明晰的3D模型。

整个进程用不到1秒。算法流弊到可以直接在普通的笔记本上跑起来。

思索到现有算法优秀的表现,研发特对以为他们可以放慢处置速度,扫描完成的一霎时也能成像恢复盲区物体。

实践路测遇到的困难

在这篇文章任务之后,SCIL的研发团队还会持续完善这套“透视”零碎。

要晓得,理想世界里,无人车行驶的环境比实验室预设的场景复杂得多。

如何疾速地呼应这些复杂的变化?如何紧缩扫描的工夫?

这些都是研发团队要处理的课题。

无人车体与盲区物体的间隔、环境的光照条件等各种要素,都会影响到光子探测器的光子捕获。要精确地复原出、“看见”盲区物体的样子,在实践行驶进程中,并不是件容易的事。

另外,这种“透视”技术还得充沛应用上散射的光子。而散射的光,还是当下车导航LIDAR零碎选择性疏忽的信息。

“我们以为,“透视”算法曾经可以用到LIDAR零碎上了,”该论文的共同次要作者,SCIL博士后Matthew O’Toole说。 “关键的成绩是,目前LIDAR零碎的硬件能不能支持这品种型的成像。”

在“透视”零碎上路之前,研发团队还有 两个方向 可以再进一步优化。

一个是在日光照射下的表现。还有怎样应对疾速挪动的物体。

比如说忽然有个篮球跑到路地方,或许飞速穿过马路的熊孩子。

研讨人员路测了他们的技术。

他们发现,这套“透视”零碎只能运用直接光。虽然这套零碎可以很灵敏地发现带反光材质的物体,比如说穿了平安服的人,或许交通标志,但是关于没有穿会反光的衣物的普通路人来说,零碎就发现不了(liao)了(le)。

“我们的任务,也算是迈出了有意义的一步。置信这个透视功用,将来会让我们一切人都受害的,”助理教授Wetzstein说,“我们接上去会增强这套零碎在实操上的适用性。”

Wetzstein除了是电子工程助理教授之外,还兼任计算机学院助理教授,并是斯坦福Bio-X和神经生物学协会的成员。

该项目的资金支持,来自于加拿大政府,斯坦福大学研讨生教育副院长办公室,国度迷信基金等五个机构。

最初,附论文地址,

https://www.nature.com/articles/doi:10.1038/nature25489

& SCIL实验室网站,

Homepage

& 编译来源,

https://news.stanford.edu/2018/03/05/technique-can-see-objects-hidden-around-corners/