雷锋网AI科技评论按 :深度神经网络由许多独自的神经元组成,它们以复杂且违背人直觉的方式组合起来,以处理各种具有应战性的义务。这种复杂性一方面赋予神经网络奥秘力气,另一方面,也让它们变成了人类难懂的黑匣子。

理解神经网络的深层功用关于解释它们是如何做决议至关重要,并且能帮我们构建更弱小的零碎。就像,你不理解各个齿轮如何配合任务,你在试图做一个钟表时就很困难。

要想了解神经迷信和深度学习中的神经网络,一种办法是弄清单个神经元的作用,尤其是那些易于解释的神经元。

DeepMind最新的一篇关于神经网络学习的论文《On the importance of Single Directions for Generalization》(https://arxiv.org/abs/1803.06959)将投稿在第六届 ICLR(国际学习表征会议)。这项研讨所采用的办法是受数十年临床神经零碎迷信的启示,经过探究损伤神经元的影响来确定小规模神经元组对神经网络的重要性。深度神经网络中的那些越容易解释的神经元对神经网络的计算功能越重要吗?

研讨人员经过删除单个神经元或神经元组来权衡它能否对网络的功能发生了影响。这项实验有了两个令人诧异的发现:

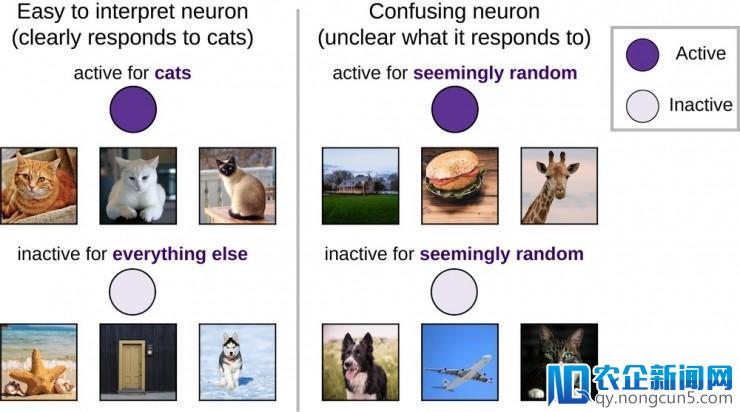

虽然以前的许多研讨集中于易了解,可解释的单个神经元(例如「猫神经元」,或深层网络的隐藏层中的神经元,它们只对猫的图像有反响),但我们发现这些可解释的神经元和那些难以了解,不可描绘的神经元对神经网络的影响,并没什么不同。

在异样删除神经元的状况下,能正确分类没见过的图像的网络比仅能对看到过的图像停止分类的网络恢复的更快。换句话说,推感性好的网络比那些单纯的记忆网络更不依赖于单一方向。

「猫神经元」能够更易解释,但它们并不重要

在神经迷信和深度学习中,普遍剖析了仅对单一输出类别的图像(例如狗)作出呼应的易解释神经元(「选择性」神经元)。这招致了在深度学习中对猫神经元,心情神经元和括号神经元过度强调它们的重要性; 在神经迷信中,对例如詹妮弗安妮斯顿神经元,以及一些相似的神经元的过度强调等等。但是,这些占多数的高选择性神经元,以及大少数低选择性、更令人隐晦且难以解释的神经元之间,哪种绝对更重要依然未知。

原句好拗口啊……

具有分明呼应形式(例如,对猫活泼,对其他一切活动不活泼)的神经元比那些随着图像随机活动或不活动的令人难了解的神经元更容易解释。

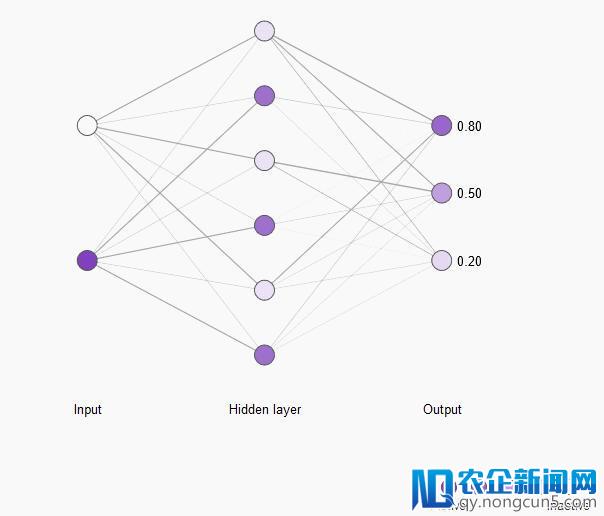

为了评价神经元的重要性,研讨人员测量了当神经元被删除时,图像分类义务的网络功能是如何变化。 假如一个神经元是十分重要的,删除它应该是具有高度毁坏性的并且大大降低网络功能,而删除一个不重要的神经元应该没有什么影响。 神经迷信家常常停止相似的实验,虽然它们很难在天然神经网络中取得这些实验所必需的细粒度和准确度。

上图是在一个复杂神经网络上删除神经元发生影响的概念图,较深的神经元更活泼。 需求留意的是,删除一个或两个神经元对输入影响很小,而删除大局部神经元会发生很大的影响,并且一些神经元比其他神经元更重要!

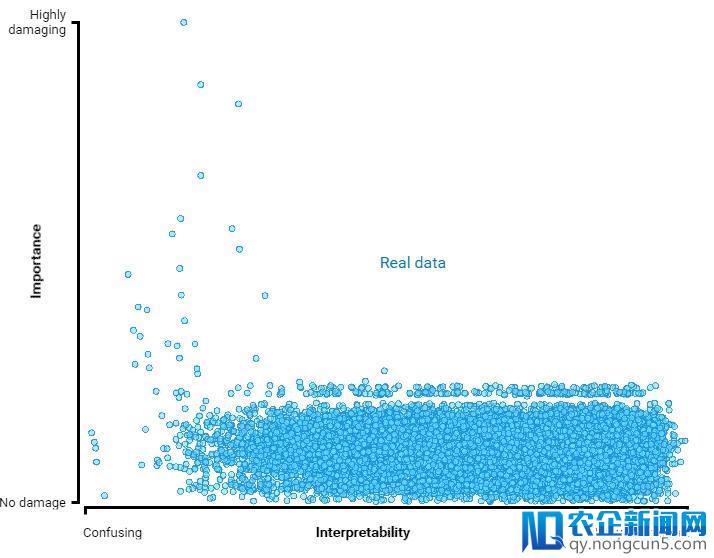

令人诧异的是,研讨员发现神经网络的选择和重要性之间简直没有关系。换句话说,「猫神经元」并不比令人难解的神经元更重要。这一发现与最近在神经迷信方面的任务相照应,曾经证明令人难解的神经元实践上可以提供丰厚的信息,并且标明今后在探究上必需逾越最易于解释的神经元,以便了解深度神经网络。

虽然「猫神经元」能够更易解释,但它们并不比那些难解释,没有分明偏好的神经元更重要。 上图反映了我们所希冀的重要性和解释性之间的不同关系!

虽然可解释神经元在直觉上更容易了解(比方,「它喜欢狗」),但它们并没有比那些没有分明偏好的难解释神经元更重要。

推感性好的网络很难打破

我们试图构建智能零碎,假如零碎可以推理出新的场景,我们只能称之为零碎智能。例如,一个图像分类网络只能对以前看过的特定狗图像停止分类,而不能对同一只狗的新图像停止分类,这个网络是没有价值的。只要在新样本中仍然能智能分类,这些零碎才干取得它们的功效。去年,Google Brain、Berkeley 和 DeepMind 协作的论文在 ICLR 2017 上取得最佳论文,标明深层网络可以复杂地记住他们承受训练的每个图像,而不是以更像人类的方式在学习(例如,理解笼统的「狗」概念)。

但是,网络能否曾经学会了一种可以推理到新的义务场景中的处理方案,这往往是不清楚的。经过逐步删除越来越大的神经元组,研讨员发现,相比于复杂记忆在训练时期看到的图像的网络,具有良好泛化才能的网络对删除神经元组后的稳健性要强得多。换句话说,泛化好的网络很难被打破(虽然它们一定还是会被打破的)。

经过以这种方式权衡网络的稳健性,可以评价一个网络能否在应用复杂的记忆来「诈骗」人类。理解网络在记忆进程中是如何变化的将有助于树立新网络,网络记忆越少,推感性就越强。

神经迷信启示剖析

总之,这些发现证明了运用基于临床神经迷信启示的技术来了解神经网络的力气是可行的。 运用这些办法,发现高选择性集体神经元并不比非选择性神经元更重要,并且那些狭义的网络比单纯记忆训练数据的网络更不依赖于单个神经元。 这些后果意味着单个神经元的重要性能够看起来的那么重要。经过努力解释一切神经元的作用,而不只仅是那些易于解释的神经元,我们希望更好天文解神经网络的外部任务,最关键的是,应用这种了解来构建愈加智能和通用的零碎。

论文地址:https://arxiv.org/abs/1803.06959

ICLR 2017最佳论文:https://arxiv.org/abs/1611.03530

雷锋网 (大众号:雷锋网) via DeepMind

雷锋网AI科技评论编译

。