“刷脸”,作为一种团体身份鉴别技术,在深度学习等技术的护持下精度得以大幅提升,在LFW上,各大玩家在有限制条件下人脸验证测试(unrestricted labeled outside data)中提交的成果普遍可以到达99.5%以上。

人脸辨认技术日益成熟的面前,作为自带AI落地基因的安防行业(数据大、高试错容忍度),这几年,天网工程普遍铺开、智能零碎全局使用,城市次序失掉了更为高效的管理和防护,民生需求失掉了更为及时的处置和反应,违背乱纪的行为能被精准辨认和处分。

与此同时,人脸辨认零碎的使用也颇受争议。

在大洋此岸的美国,亚马逊因向美国执法机构提供人脸辨认技术而遭到某联盟的谴责。该联盟表示,“亚马逊以非常昂贵的价钱向美国警方提供人脸辨认效劳,能够会招致美国公民的公家数据被滥用及隐私遭到进犯”。

在他们看来,将人脸辨认技术使用到前端视频监控摄像机上,能够会打破隐私及适用性之间的均衡。假定美国警方有若干台这样的安防摄像机,同时拥有可疑人员的“黑名单”照片库,那么其他任何人假如与这些可疑人员有一些相像,一旦进入警察的安防摄像机的镜头之内,都有能够遭到警务人员的盘诘。而大少数美国人不希望生活在那样的世界里。

从这来看,技术使用的双刃剑在人脸辨认的落地上就得以表现,且不说人脸辨认技术开展关于人类来说优多(平安)还是劣多(隐私),硬币抛下落地的能够性还是失掉了均衡。

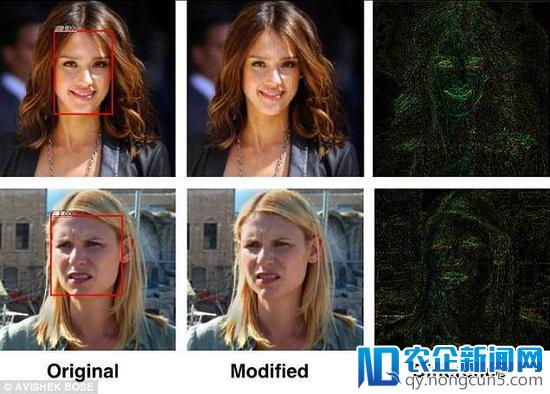

近日,多伦多大学教授Parham Aarabi和他的研讨生Avishek Bose开发了一种算法,经过对图像停止“光转换”,可以静态地毁坏人脸辨认零碎。

与上述联盟控诉亚马逊的理由一样,这位大学教授也思索到了隐私成绩,“随着人脸辨认技术越来越先进,团体隐私成为了一个真正急需处理的成绩,这就是反人脸辨认零碎被研发的缘由,也是该零碎的用武之地。”

依据Aarabi的说法,他们次要采用了对立训练(adversarial training)技术,使得两个神经网络互相对立,一个神经网络从数据中获取信息(人脸数据),另一个神经网络试图去毁坏第一个神经网络执行的义务。

据悉,他们的算法是在包括不同种族,不同光照条件和背景环境下的超越600张人脸照片的数据集上停止训练的(业界规范库),两个神经网络互相对立会发构成一个实时的“过滤器”,它可以使用就任何图片上。由于它的目的——图像中的单个像素是特定的,改动一些特定像素,肉眼是简直无法发觉的。比方说检测网络正在寻觅眼角,搅扰算法就会调整眼角,使得眼角的像素不那么显眼。算法在照片中形成了十分巨大的搅扰,但关于检测器来说,这些搅扰足以诈骗零碎。

“此前多年,这些算法必需由人类去定义,如今的神经网络可以自主学习。目前我们的算法将人脸辨认零碎中被检测到的人脸的比例降低到了0.5%。我们希望在APP或网站上提供这种神经网络零碎,这是一个十分有意思的范畴,有着十分大的潜力市场,”Aarabi教授说道,“另外研讨报告也将在2018年IEEE国际多媒体信号处置研讨会上宣布”。

其实,毁坏人脸辨认产品辨认率的产品并不少见。早在2016年,卡内基梅隆大学的研讨人员就设计了一种眼镜框,可以误导面部移动互联网在带来全新社交体验的同时,也或多或少使人们产生了依赖。移动互联网使网络、智能终端、数字技术等新技术得到整合,建立了新的产业生态链,催生全新文化产业形态。辨认零碎,使其发生错误的辨认。

该AI已经渗透到了生活中的方方面面。在智能交通领域,人工智能技术也正在发挥作用。类软件在学习人脸的容貌时,它十分依托于特定的细节,如鼻子和眉毛的外形。卡内基梅隆大学打造的眼镜并不只是掩盖那些脸部细节,还会印上被计算机以为是人脸细节的图案。 雷锋网雷锋网

来自VentureBeat,雷锋网 (大众号:雷锋网) 编译

。