说起机器人爬楼梯,不少人可能会想起波士顿动力那只黄色的 SpotMini 机器人。

如果你觉得 SpotMini 能通过视觉分析路况已经很棒, 那 MIT 的 Cheetah 3 肯定会让你觉得更惊艳,因为它不仅可爬楼梯可跳跃,而且一切都是在不依赖视觉的情况下完成。

要是它踏在了一些镜头看不到的东西上,那该怎么办?我们不想过于依赖视觉。

其中一位参与到 Cheetah 3 项目的工程师 Sangbae Kim 说。不靠视觉或任何传感器,机器人又是怎样获取了解路面情况?

就和在漆黑环境中前进的人类一样,Cheetah 靠的也是“摸黑前行(blind locomotion)”。具体来说,Cheetah 主要依赖两套新算法:1. 接触感应算法;2. 模型预测控制算法。

简单来说,接触感应算法可以帮 Cheetah 判断某只机械腿接触到的平面是否可“踏下去”,以及下一步又应该怎样反应。

▲ “摸黑”爬楼梯

碰了一下后,算法得快速判断机器人脚下是脆弱的树枝,还是踏实的路面,它能不能踏下去?如果不可踏下去,算法会结合反馈数据决定,接下来机械腿是要赶紧抬起来,还是通过摇摆来保持机器人整体平衡。

至于模型预测控制算法,主要用于帮助机器人判断,每踏出一步,到底需要用多大力,最终才能帮助机器人人保持平衡?

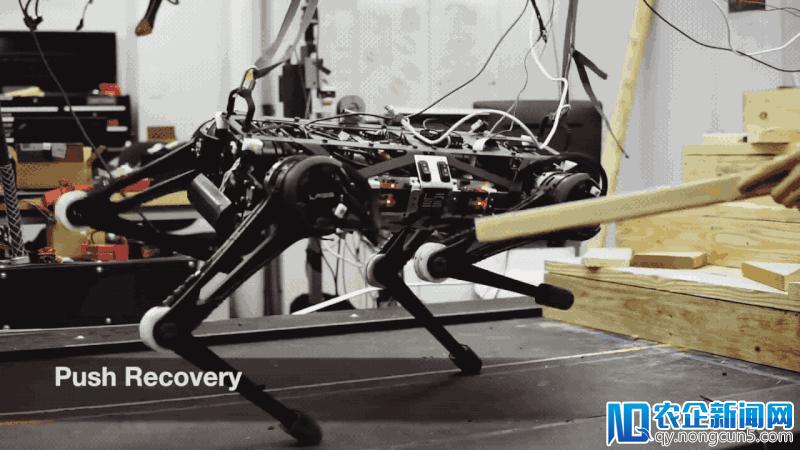

除了要“踏好每一步”,这个算法另一个任务在于帮助机器人在遇到意外阻力时,要怎样恢复到平衡状态。

譬如说,有人在侧边踢了机器人一脚。算法就会想,‘我刚刚在左边遭遇了一个意外速度,我要怎样控制每只脚的用力状态,才能保持平衡?如果我在相反方向施下 100 牛顿的力,半秒之后会发生什么事?’

Kim 解释道。这个算法可进行帮助机器人面对研究人员的突然拉扯和推力。

▲ “推啥推!”(口亨

视觉判断可能会面临干扰因素、不准确或情况不适用等问题。所以说,如果你的机器人过于依赖视觉,它对空间的判断必须得非常准确,这会使得它反应非常慢。

因此,我们希望它可以更依赖触觉信息,这样一来,它能在快速移动时,仍可应对意外障碍物。

Kim 补充说。此外,这个功能也是出于对 Cheetah 作用定位的考虑。

和旨在进入办公室和家庭的 SpotMini 不同,Cheetah 的使命在于去到人类不适宜到达地方,深入譬如坍塌大楼的废墟、受核辐射影响地区等地方,进行拯救等工作。 这也是意味着它需要面对更复杂的路面情况、更黑暗的环境。

不过,Kim 表示,他们还是会为 Cheetah 装上视觉系统,但“不想将视觉作为控制第一位”。

除了“摸黑”系统外,Cheetah 3 和上一代相比,机器灵活度也提升了不少。

▲ 可逆转膝关节系统,真 · 机器人舞

▲ 灵活摆动

▲ 弓背弹跳,后面的研究人员看得也太乐了吧

相比之下,能开门的黄色 SpotMini 和 Cheetah 3 你比较喜欢哪个呢?

题图来自 MIT