雷锋网 (大众号:雷锋网) AI 科技评论按:AAAI 2018 将于 2 月 2 日 - 2 月 7 日 在美国新奥尔良举行,雷锋网(大众号:雷锋网) AI 科技评论也将到现场停止一线报道。

在往年的 AAAI 2018 上,阿里巴巴共有 11 篇论文被录用,并做了一系列的论文解读。本文为阿里巴巴业务平台事业部供稿,雷锋网 AI 科技评论经受权发布。

论文称号:Syntax-aware Entity Embedding for Neural Relation Extraction(句法敏感的实体表示用于神经网络关系抽取)

团队称号:业务平台事业部

作者:何正球,陈文亮,张梅山,李正华,张伟,张民

摘要

关系抽取义务大规模使用的一个次要瓶颈就是语料的获取。近年来基于神经网络的关系抽取模型把句子表示到一个低维空间。这篇论文的创新在于把句法信息参加到实体的表示模型里。首先,基于 Tree-GRU,把实体上下文的依存树放入句子级别的表示。其次,应用句子间和句子外部的留意力,来取得含有目的实体的句子集合的表示。

研讨背景和动机

关系抽取义务大规模使用的一个次要瓶颈就是语料的获取。近程监视模型经过将知识库使用于非构造化文本对齐来自动构建大规模训练数据,从而加重对人工构建数据的依赖水平,并使得模型跨范畴顺应才能失掉加强。但是,在应用近程监视构建语料的进程中,仅仅应用实体称号停止对齐,而不同实体在不同关系下应该具有愈加丰厚的多样的语义表示,从而招致错误标注等成绩。因而,一套愈加丰厚的实体表示显得尤为重要。

另一方,基于语法信息的办法通常作用于两个实体之间的关系上,而语法信息是可以愈加丰厚实体的表示的。因而,本文基于句法上下文的实体表示来丰厚实体在不同关系形式下的语义,并结合神经网络模型处置关系抽取义务。

相关任务引见

我们把相关的任务大致分红晚期基于近程监视的办法和近年来基于神经网络模型两类。

为理解决关系抽取义务严重依赖于标注语料的成绩,Mintz et al.(2009)率先提出了基于近程监视的办法构建标注语料。但是,这样构建的自动标注语料含有少量的噪声。为了缓解语料中噪声带来的影响,Riedel et al.(2010)将关系抽取看成是一个多实例单类别的成绩。进一步的,Hoffmann et al.(2011)和Surdeanu et al.(2012)采取了多实例多类别的战略。同时,采用最短依存途径作为关系的一个语法特征。上述办法典型的缺陷在于模型的功能依赖于特征模板的设计。

近年来,神经网络被普遍的使用于自然言语处置义务上。在关系抽取范畴,Socher et al.(2012)采用循环神经网络来处置关系抽取。Zeng et al.(2014)则构建了端到端的卷积神经网络,进一步的,Zeng et al.(2015)假定多实例中至多有一个实例正确地表示了相应的关系。相比于假定有一个实例表示一对实体的关系,Lin et al.(2016)经过留意力机制挑选正面的实例更充沛的运用了标注语料含有的信息。

以上这些基于神经网络的办法大少数都运用词层次的表示来生成句子的向量表示。另一方面,基于语法信息的表示也遭到了众多研讨者的喜爱,其中最次要的即最短依存途径( Miwa and Bansal (2016)和 Cai et al.(2016))。

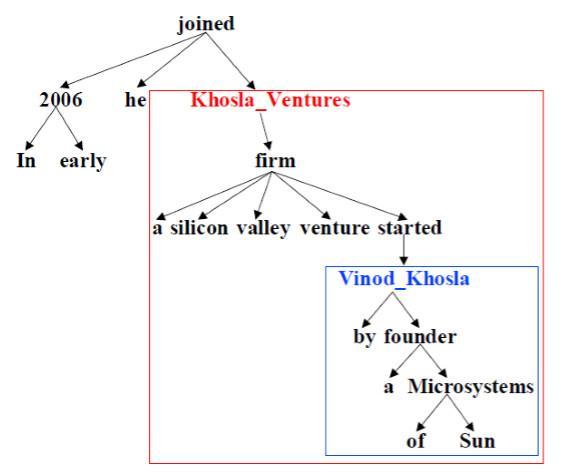

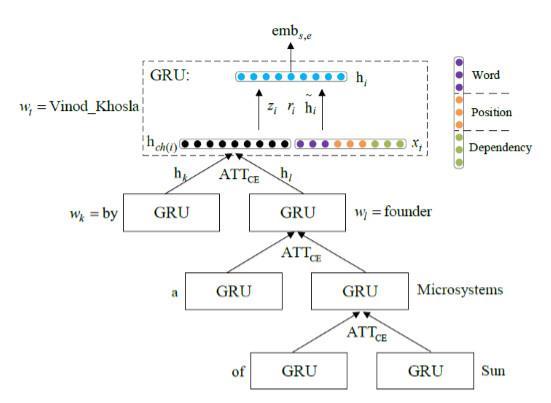

次要办法

首先,基于依存句法树,应用基于树构造的循环神经网络(Tree-GRU)模型生成实体在句子级别的表示。如上图所示,有别于仅仅运用实体自身,我们可以更好地表达出长间隔的信息。详细的实体语义表示如下图所示。我们运用 Tree-GRU 来取得实体的语义表示。

其次,应用基于子节点的留意力机制(ATTCE,上图)和基于句子级别的实体表示留意力机制(ATTEE,下图)来加重句法错误和错误标注的负面影响。

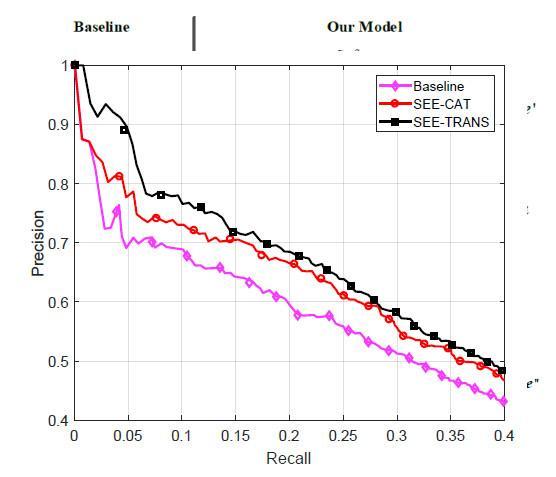

实验后果

本文在 NYT 语料上停止了实验。最终后果如上图所示。其中,SEE-CAT 和 SEE-TRAINS 辨别是本文运用的两种结合三种向量表示(句子的向量表示,两个实体的向量表示)的战略。从图中可以看出,本文提出的模型在相反数据集上获得了比现有近程监视关系抽取模型更好的功能。

总结

本文的实验后果标明,更丰厚的命名实体语义表示可以无效地协助到最终的关系抽取义务。

假如您也有论文被 AAAI 录用 ,欢送关注雷锋网 AI 科技评论(aitechtalk),在后台留下联络方式,雷锋网将与您联络,并停止更多交流!

雷锋网版权文章,未经受权制止转载。概况见。