大众号:机器之心

自arXiv

作者:Matthew Tesfaldet等

机器之心编译

参与:路、李泽南

图画总是只能表现事物霎时的抽象,而动画则需求逐帧手绘,费时费力,人工智能能否可以协助我们处理这一困难?近日,来自加拿大约克大学、Ryerson 大学的研讨者们提出了运用「双流卷积神经网络」的动画生成办法,其参考了人类感知静态纹理画面的双途径形式。该动画生成模型可以参考相关视频,让一张静态图片变成效果逼真的动画。目前,该研讨的论文已被 CVPR 2018 大会接纳,相关代码也已地下。

项目展现页:https://ryersonvisionlab.github.io/two-stream-projpage/

动画生成效果展现

很多罕见的时序视觉形式运用组成元素的外观和静态(即时序形式变化)的集合停止描绘。此类形式包括火、摇曳的树木和波浪崎岖的水。临时以来,了解和特征化这些时序形式是人类感知、计算机视觉和计算机制图范畴感兴味的成绩。之前的研讨给这些形式起了很多名字,如涡流运动(turbulent-flow motion)[17]、时序纹理(temporal texture)[30]、时变纹理(time-varying texture)[3]、静态纹理 [8]、纹理运动(textured motion)[45] 和时空纹理(spacetime texture)[7]。本论文作者运用「静态纹理」(dynamic texture)。该研讨提出从外观和时序静态的角度对静态纹理停止因子剖析。然后运用因子分解后果完成基于示例纹理输出的静态纹理分解,从而生成新型静态纹理实例。它还发生了一种新型作风迁移方式,目的外观和静态可来自不同来源,如图 1 所示。

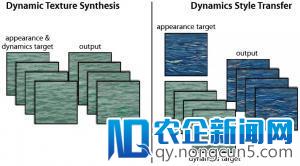

图 1:静态纹理分解。(左)给出一个输出静态纹理作为目的,本文提出的双流模型可以分解一个新的静态纹理,保存目的的外观和静态特征。(右)双流模型使分解结合一个目的的纹理外观和另一个目的的静态,从而发生二者的分解品。

本研讨提出的模型由两个卷积网络(ConvNet)构成——外观流和静态流,二者辨别经过预训练,用于目的辨认和光流预测。与空间纹理研讨 [13, 19, 33] 相似,本文依据每一个流的滤波器输入的时空数据集,总结输出静态纹理。外观流建模输出纹理每一帧的外观,静态流建模时序静态。分解进程包括优化随机初始化的噪声形式,以使每个流的时空数据与输出纹理的时空数据相婚配。该架构遭到人类感知和神经迷信的启示。详细来说,心思物理学研讨 [6] 显示人类可以感知静态纹理的构造,即便是在没有外观提示的状况下,这标明两个流是独立的。相似地,双流假定 [16] 从两个途径建模人类视觉皮层:腹侧流(担任目的辨认)和背侧流(担任运动处置)。

本文提出的对静态纹理的双流剖析也被使用于纹理分解。研讨者思索了少量静态纹理,并展现了其办法可以生成新型高质量样本,婚配输出样本的逐帧外观和时序变化。此外,外观和静态的因子分解还发生了一种新型的作风迁移方式,一个纹理的静态可以与另一个纹理的外观结合起来。我们甚至可以运用单个图像作为外观目的来完成该操作,使静态图像变成动画。最初,研讨者经过少量用户调研验证了其生成纹理的逼真水平。

技术办法

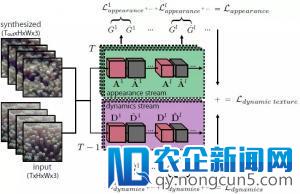

本文提出的双流办法包括外观流(表示每一帧的静态(纹理)外观)和静态流(表示帧与帧之间的时序变化)。每个流包括一个卷积神经网络,其激活数据被用于特征花静态纹理。分解静态纹理是一个目的为婚配激活数据的优化成绩。本文提出的静态纹理分解办法见图 2。

图 2:双活动态纹理生成。Gram 矩阵集表示纹理的外观和静态。婚配这些数据才干完成新纹理的生成和纹理之间的作风迁移。

图 2:双活动态纹理生成。Gram 矩阵集表示纹理的外观和静态。婚配这些数据才干完成新纹理的生成和纹理之间的作风迁移。

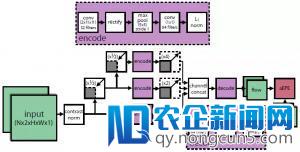

图 3:静态流卷积神经网络。该 ConvNet 基于面向时空的能量模型 [7,39],同时经过光流预测的训练。图中显示了三个扩展(scale),理论中研讨者运用了五个扩展。

实验后果

(静态)纹理分解的目的是让计算机生成人类察看者无法区分能否为真实图像的样本。该研讨同时也展现了各种分解后果,以及少量用户调研,以定量评价新模型生成图像的逼真水平。由于生成图像随工夫变化的特性,本研讨的后果多为视频展现。研讨人员表示,该双流架构是由 TensorFlow 完成的,并运用 NVIDIA Titan X(Pascal)GPU 生成后果,图像分解的工夫介于 1-3 小时之间,每次生成 12 帧,图像分辨率为 256×256。

论文:Two-Stream Convolutional Networks for Dynamic Texture Synthesis

论文链接:https://arxiv.org/abs/1706.06982

摘要:本论文提出了一个用于静态纹理分解的双流模型。我们的模型基于两个预训练的卷积神经网络(ConvNet),辨别针对两个独立义务:目的辨认、光流预测。

给定一个输出静态纹理,来自目的辨认卷积神经网络的滤波器呼应数据紧缩输出纹理在互联网思维的影响下,传统服务业不再局限于规模效益,加强对市场的反应速度成为传统服务业发展的首要选择。在互联网思维下,通过对传统服务业的改革,为传统服务业发展创造了全新的天地。每一帧的外观,而来自光流卷积神经网络的数据会对输出纹理的静态停止建模。为了生成全新的纹理,随机初始化输出序列经过优化后,用于婚配输出纹理的数据与每个流的特征数据。遭到近期关于图像作风迁移的启示,同时受害于本文提出的双流模型,我们还尝试分解一种纹理的外观与另一种纹理的静态,以生成全新的静态纹理。实验标明,我们提出的办法可以生成全新的、高质量样本,可婚配输出纹理的逐帧外观及其随工夫的变化。最初,我们经过深化的用户研讨,对新的纹理分解办法停止量化评价。