雷锋网 AI 科技评论按:这篇文章来自资深机器学习专家、NIPS 2017 「工夫检验奖」( Test of Time Award ) 取得者 Ali Rahimi。上一次 Ali 在获奖演讲中把深度学习比作炼金术惹起了深度学习界的大规模的讨论, Yann LeCun 也和他掐了起来 ,但最终大家都认可深度学习的实际根底还不够扎实。另一方面,深度学习热度不减,不只各个知名大学的相关硕士博士请求火爆,甚至本科和高中阶段都有学校开端思索设置机器学习/人工智能课程,其中当然也少不了身处潮头浪尖的深度学习。

那么,Ali 就提出了上面这个成绩。

你会以为深度学习技术曾经成熟到了能在中学中教授这门课程吗?

Ali 把这个成绩引发的考虑写成了一篇文章。雷锋网 (大众号:雷锋网) AI 科技评论全文编译如下。

你会以为深度学习技术曾经成熟到了能在中学中教授这门课程吗?

我为什么会这样问呢?不久前,我收到了一位大公司的产品经理的电子邮件。由于我自己喜欢将公家邮件发布开来,所以,上面我将它贴了出来:

来自:M.

您好,Ali,

…

请问您是如何教团队中年老的成员们测试他们关于模型参数的预见或许取得这种直觉呢?

我们团队中的工程师们常常从其他的迷信家的研讨后果那里直接「 承继 」超参数,但他们非常畏惧本人调参。

这封电子邮件让我堕入了好几天的深思中。我久久不能想出一个有建立性的答案。

假如真实要我答复的话,我想说:他的工程师们的确应该感到惧怕!

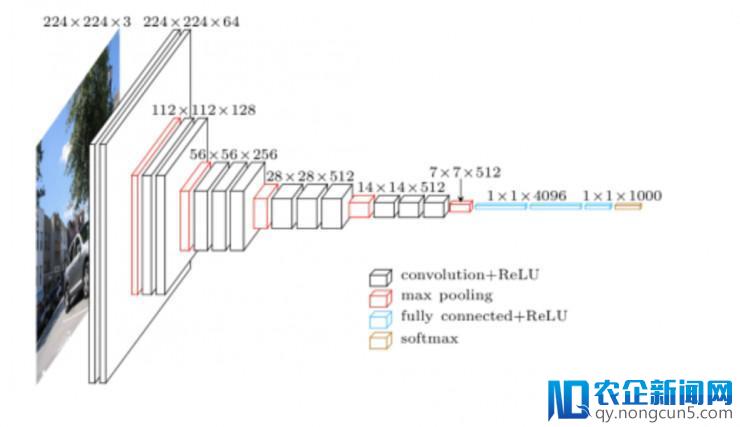

假设,你是一名工程师,面对下面这个网络,你需求让它在特定的数据集上更好地任务。你可以以为这些网络层的存在都是有其缘由的。但作为一个迷信范畴,我们至今还没有一个通用的方式去表述这些缘由。我们教授深度学习的方式与我们教授其他学科的方式差异很大。

光学工程师们是如何展开任务的

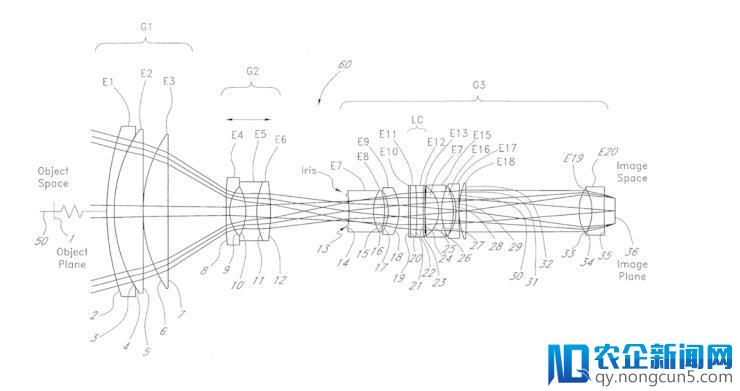

几年前,我接触到了光学范畴。在光学范畴中,你也会构建一层层组件来处置输出。上面是一个相机的镜头:

为了设计这样的东西,你将首先运用根本的光学构造,它们通常是以创造它的名人的名字命名的。你会停止仿真实验,发现它哪些中央不契合你的要求,然后拔出额定的镜片来纠正缺陷。

接着,你要经过一个数值化的优化器来处置整个零碎,对诸如曲面的外形、地位、倾斜度等参数停止调整,使得一些设计目的最大化。然后,你会再停止仿真,修正设计,优化零碎,并且一次次反复这个进程,直到零碎满足需求。

这个进程和深度神经网络何其类似!

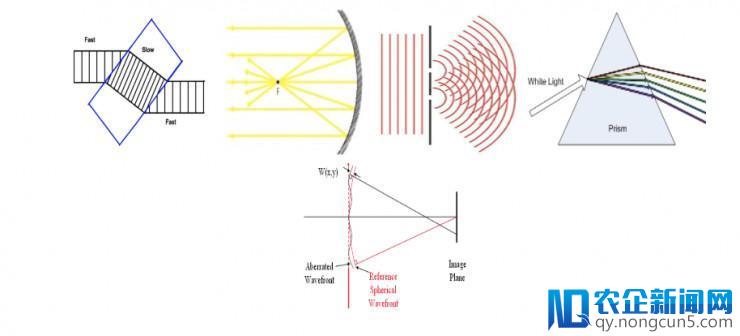

这一串构造中的 36 个镜片都是有着特定的意义才被拔出其中的,它们辨别担任纠正某些特定的异常状况。这就要求我们有一个十分明晰的心思模型,弄清每个镜片对透过它的光线有什么作用。这种心思模型通常是以某个功用为根据得来的,比方折射、反射、衍射、色散,或许波前校正。

人们并不畏惧这个设计进程。每年,美国都无数以百计的光学工程师毕业,从事设计镜头的任务。他们并不惧怕本人的任务。

这不是由于光学是非常复杂的。这是由于他们很好的组织了光学的心思模型。

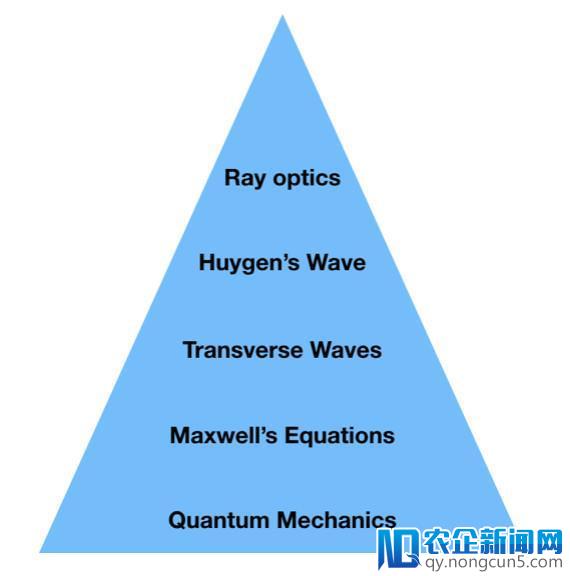

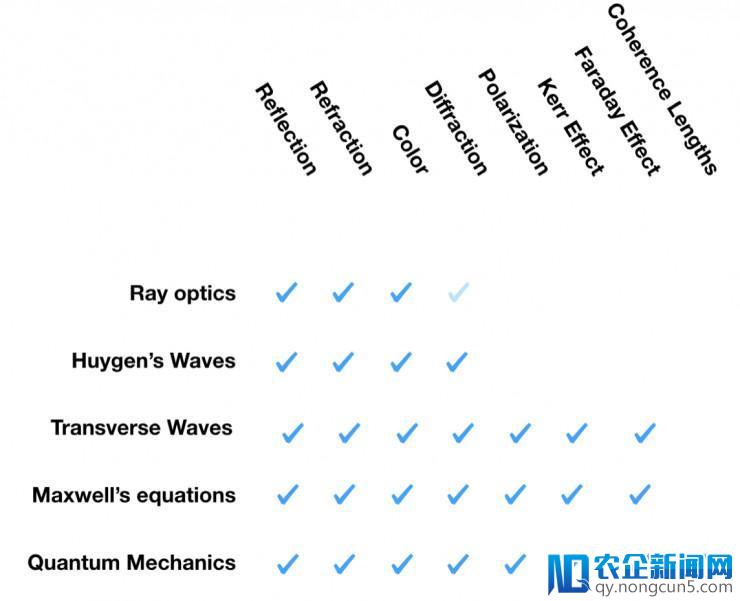

古代光学的教学被笼统成了不同的层次。

在最下面,是最复杂的一层——射线光学。射线光学是波光学的一种简化,在波光学中,光线代表波前的法向量。波光学是麦克斯韦方程组的近似解。麦克斯韦方程组可以从量子物理中推导出来,而这我就不是非常理解了。

每一层都经过简化假定的方式从上面的层脱胎而来。因而,每一层都可以解释比下面的一层愈加复杂的景象。

我把大局部的工夫花在了设计最下面的四个笼统层上。

这就是我们明天教授光学的办法。但是这些实际并不总是像下面的网络构造这样组织起来的。直到一百年前,这其中的一些实际还以一种互相矛盾的形态共存。从业者所能依赖的仅仅是一些缺乏威望的、非正式的关于光学实际。

在牛顿方式化定义射线光学的近一百年之前,下面提到的这种情况并没有阻止伽利略制造出一个十分棒的望远镜。在伽利略的脑海里,他有一个足够优秀的关于光线的心思模型,这使得他可以制造出一个能将物体缩小十倍的望远镜。但是他关于光学的看法也存在一些缺乏,致使于他不可以校杂色差,或许取得更广大的视场。

在这些光线的实际被一致成笼统层的堆叠之前,每一种学说都需求从对光线的根本概念开端。这样会假造出一套新的不实在际的假定。牛顿的射线光学将光线建模成可以被固体物质吸引或许排挤的雾状粒子。惠更斯将光线建模成一种经过奥秘的媒介「以太」传达的纵向压力波。他像声响一样对光线建模。麦克斯韦也假定光线经过「以太」传达。你还可以在麦克斯韦方程组的系数中看到这种假定的痕迹。

是的这是一个愚笨的模型!但是它可以被量化,有预测的才能。

虽然这些假说如今听起来能够很愚笨,但是,这些模型是可以量化的,并且他们有预测的才能。你可以将数据填入这些零碎中并且失掉数值化的预测作为输入。这关于工程师来说是非常有用的!

那么关于深度学习……

在深度学习中我们要探究什么呢,就是要找到一种用于描绘深度学习中每一层的功用的模块化言语。

假如我们可以像在光学中描绘光线如何穿过一个光学器件那样描绘深度神经网络中的每一层具有怎样的功用,我们设计深度神经网络的任务会愈加复杂。

我以为卷积层的功用是运转与他们的输出相婚配的过滤器,池化层则是紧随其后的非线性单元。这是一个较为「 底层 」的描绘,相似于从麦克斯韦方程组的角度来描绘镜头的功用。

也许存在我们可以依赖的更「 高层 」的笼统概念,我们可以依据数据的数值经过网络层之后被修正的量化状况来描绘网络层的功用,这相似于依据镜头如何使光线弯曲来描绘它的功用。

并且,假如这个笼统概念是可以被量化的那就更高了。这样一来,你可以将数字输出到一个公式中,停止粗略的剖析,这会协助你设计你的网络构造。

我们间隔这样的言语还很悠远。那么,让我们从更复杂的状况动手。

但是,也许我被梦想带跑偏了!

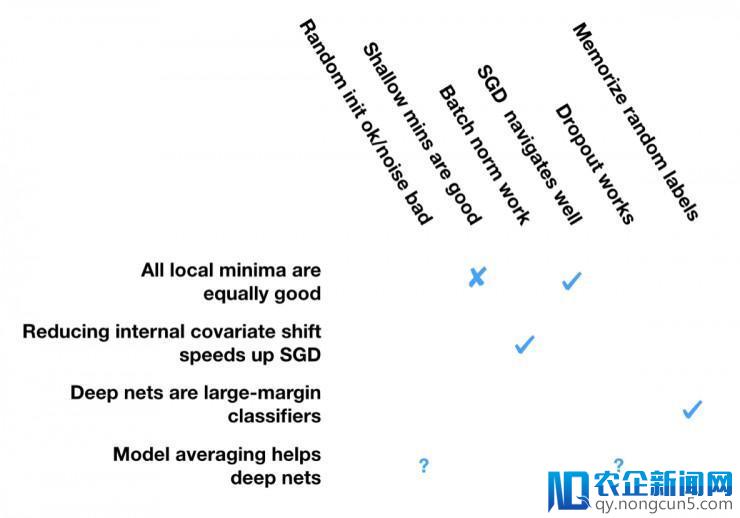

让我们从更复杂的状况动手吧。我们有很多关于深度神经网络的训练如何任务的心思模型。我曾经搜集好了一些值得解释的景象的案例。让我们看看这些心里模型是如何很好的解释这些景象的。

在我更深化的剖析之前,我供认这个小研讨是非常粗糙的。光学用了长达 300 多年去做到这一点,而我只花了一个星期六的下午去做这个研讨。相应地,我只将我的发现宣布在了我的博客中。

-

景象:随机梯度下降(SGD)算法的随机初始化足够好,但是之后小的数值错误或许不恰当的步长会毁坏随即梯度下降进程。

一些从业者曾经留意到,梯度积聚的方式的巨大变化会招致在测试集上宏大的功能差别。比方,当你运用 GPU 而不是 CPU 停止训练时( https://github.com/tensorflow/tensorflow/issues/2226 , https://github.com/tensorflow/tensorflow/issues/2732 ),就会呈现这种状况。

你以为这是一个值得解释的合理的观测后果吗?或许你以为这能够是伪造的、不真实的观测后果呢?或许也许你以为这个观测后果中有些错误,就像它在一定水平上逻辑上自相矛盾?或许它的表述是不恰当的。

我敢一定你此时一定悲喜交集。但是暂且让我们把它作为一个景象记载上去,持续停止我们的研讨。

-

景象:浅层模型的部分最小值比锋利的最小值的泛化才能更好

这个说法如今十分盛行。一些人坚持它是正确的( https://arxiv.org/abs/1609.04836 , https://arxiv.org/abs/1611.01838 , https://arxiv.org/abs/1704.04289 , https://arxiv.org/abs/1710.06451 ),包括我在内的其别人以为这个说法从逻辑上看就不正确,那些以为它正确的人反驳道:从经历下去说,这个说法确实是正确的( https://arxiv.org/abs/1703.04933 )!如今,有的研讨者曾经对这个说法加以提炼,得出了变体的版本( https://arxiv.org/abs/1706.08947 )。这个说法至今令人困惑( https://twitter.com/beenwrekt/status/941005520420225025 )。

我需求指出,这个景象能够是充溢争议的,但是虽然如此还是把它记载上去吧。

-

景象:嵌入批量正则化(BN)层会减速随机梯度下降

「 批量正则化是无效的 」这说法是简直毫无争议的。我在此仅仅举出一个反例( http://nyus.joshuawise.com/batchnorm.pdf ),并且将这个景象记载上去,不予置评。

-

景象:虽然存在很多部分最优点和鞍点,但随机梯度下降算法总能成功处理优化成绩

关于这个成绩,人们有各种各样的说法。一个常常被提到的说法是,在深度学习训练的损失函数的面上普遍存在鞍点和部分最小值(

https://arxiv.org/abs/1712.04741

)。此外,人们要么以为梯度下降可以克制这个成绩(

https://arxiv.org/abs/1412.6544

),要么以为没有必要克制这个成绩就可以得出一个可以被很好的泛化的解(

https://arxiv.org/abs/1712.04741

)。也有人以为深度学习模型的损失外表总体下去说是很益处理的(

http://openaccess.thecvf.com/content_cvpr_2017/html/Haeffele_Global_Optimality_in_CVPR_2017_paper.html

)。

在这里,我勉强将这个景象记载上去。

-

景象:Dropout 比其他的「 随机化战略 」愈加无效

我不晓得如何将相似于 Dropout 的算法归类,所以我在这里将他们称为「 随机化战略 」。

很抱歉,在这里我仅仅将它记载上去,不加以评论。

-

景象:深度神经网络可以记住随机的标签,并且可以将其泛化

这里的证据是很清楚的(

https://arxiv.org/abs/1611.03530

),我亲爱的冤家们发现了它们并支持这个观念。

虽然富有争议,我在这里还是将它记载上去。

阐明

我们曾经发现了一些景象。从我下面援用的论文中,我也曾经失掉了我以为可以可以在最佳的水平上解释这些景象的学术实际。

让我们一同来看看我们的研讨停顿:

但我们依然别快乐的太早,我们还面临着以下的成绩:

首先,我并不认同我们我们在一开端想要解释的一些观测后果是合理的

第二,我不能将这些解释组织成一个层次化的笼统,不能像光学的层次化笼统那样分明的表述出来。

第三,我疑心我从论文中援用的一些实际并不是正确的。

我的观念

少量的新人涌入到了我们这个行业中,而我们通常差不多都是用一些不标准的方式培训他们,教给他们一些预训练好的深度神经网络,随后就要求他们能本人创新。关于那些需求解释的景象,我们本人都不能达成分歧。想要在高中就能教这些东西,我们还离得太远了。

那么我们该怎样做呢?

假如我们可以提供由不同层次的笼统层组成的心思模型,用于描绘深度学习网络中每一层的功用,那就太好了。在深度学习范畴,我们与「 折射率 」、「 色散 」、「 衍射 」绝对应的概念是什么呢?也许你曾经考虑过这些成绩,但是我们没有把我们关于这些概念的言语规范化。

让我们将我们都赞同的一组景象归拢。接着,我们可以试着去将它们解释清楚。什么是我们等价于牛顿环、克尔效应、法拉第效应的东西呢?

我和一小群同事开端停止了一项实证研讨,试图将我们范畴内的心思模型停止分类,使之方式化,然后用实验验证他们。这是一项很大的工程。我以为这是树立一个层次化的深度学习心思模型、得以在高中开设深度学习课程的第一步。

via argmin ,雷锋网 AI 科技评论编译

。