源 | 小象 编译 | 小象-陈志扬、陈圣茜

什么是集成办法?集成办法是一种机器学习技术,他结合了多个根本模型,目的是获取一个最佳预测模型。为了更好天文解这个概念我们需求回忆一下机器学习的最终目的和模型构建的整个进程,而本文则会深化使用集成学习的详细算法实例和使用缘由来停止讲述。

本文将次要运用决策树对集成办法的定义与适用性停止扼要的概述,但是需求晓得的是集成办法还可以使用于决策树以外的其他算法中。

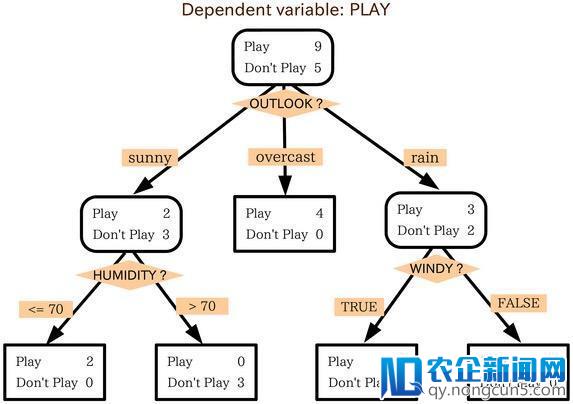

决策树经过一系列成绩和条件来确定预测值。如上图,这个复杂的决策树可以决议我们能否可以在外游玩。它将几个天气要素归入考量,在思索每个要素之后,会给出一个决议或是提出另外一个成绩。

在这个例子中,假如天气是阴天,我们将出门游玩;但是假如是雨天,我们会再思索能否刮风,假如刮风我们就不出去了。但是假如没有刮风,那就把鞋带系好吧——由于我们要出去游玩了。

决策树异样也可以用相反的形式处理定量成绩。在上图的决策树中,我们想要晓得能否应该投资商业地产。它是办公楼,仓库,还是公寓楼?经济条件是好是坏?这项投资能带来多少报答?在用这个决策树的求解进程中,这些成绩都需求被答复。

当我们构建一棵决策树的进程中,我们需求思索以下成绩:我们要基于哪些特征来做决策?以什么阈值来把成绩的答案归为是或否?在第一个例子中,假如我们在决策树中讯问了有冤家一同会怎样样?

假如有,在任何状况下的决策都是出去游玩;假如没有,我们才会持续根据天气来做出决策。经过添加一个额定的成绩,我们希望更好地划分答复是与否的状况。

这就是我们为什么要运用集成办法的缘由!相比拟于依赖一棵决策树并希冀它能在每一个分支点都做出正确的决议,集成办法允许我们同时参考一堆决策树样本,计算出在每个分支点应该运用哪些特征、提出什么成绩,并依据这些决策树样本汇总的后果来做出最初的预测。

集成办法

1. BAGGing算法,或称Bootstrap-AGGregating算法。叫BAGGing这个名字,是由于它是综合了Bootstrapping和Aggregagtion而构成的一个组合模型。

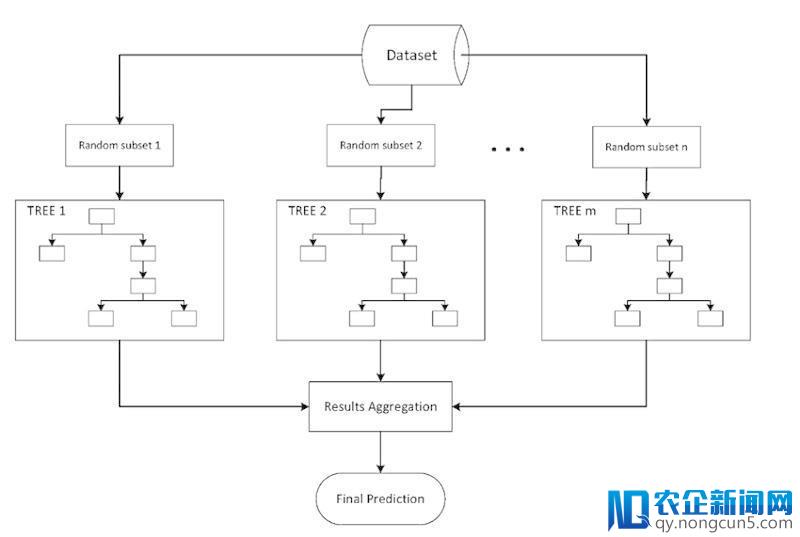

若我们有一组数据样本,可以应用Bootstrap算法抽取出多个子集,然后在每个子集上训练一棵决策树,并应用算法将这些决策树交融成一个效果最好的分类器。上面这张图可以让我们更好天文解这个流程:

一个数据集,应用Bootstrap算法失掉若干子集,然后在每个子集训练一棵决策树。一切决策树失掉的后果可以被汇总失掉一个最精确、高效的后果。

高端智能装备、新一代信息技术、新能源、新材料、新制造、新零售、新技术、生物制药等新的产业集群正在迸发活力;创新驱动、科技支撑、知识产权转化、技术转移等新的动能正在超越旧的动力,新经济成为支撑经济发展的重要力量。

2. 随机森林模型。随机森林模型可以以为是相似于BAGGing的一种算法,只是在细节上稍有不同。在确定如何分支与做决策时,BAGGing算法中的决策树可以从一切特征中去选择。

因而,即便经过Bootstrap算法失掉的子样本组也许有纤细差别,数据全体上还是会被每棵决策树以相反的特征开端划分。与此相反,随机森林模型在随机选取的一局部特征中,选取特征来划分。

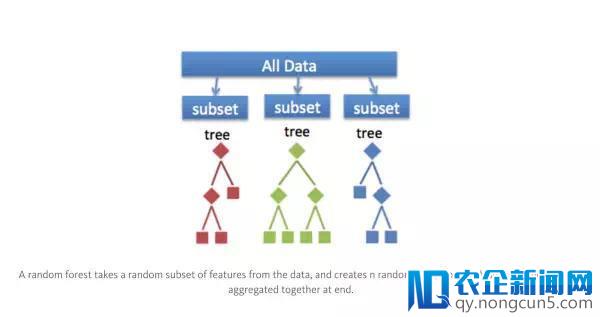

相比于在每个节点都运用类似的特征来划分,随机森林模型在各个子模型间表现出了更多的差别——由于每棵决策树会基于不同特征集合来划分。这种水平的差别性使得随机森林能在更大的范围内停止模型交融,从而失掉一个愈加精确的预测。我们可以参考以下这张图来了解这个进程。

随机森林运用数据的一组随机特征,并应用每一组生成若干棵随机树。这些树在最初会被整分解一个模型。

与BAGGing算法类似,我们需求用Bootstrap算法从数据集中取出若干子集,并在每个子集上训练一棵决策树。但是,这些决策树会依据不同的特征分支(上图中的特征用外形来表示)。

总结

任何机器学习成绩的目的都是找到一个模型能最好地预测我们所想要的后果。相比拟于构建一个模型并寄希望于这个模型是我们所能生成的最好的模型,集成办法参考了多个模型并将他们交融成一个最终模型。

我们需求晓得决策树不是运用集成办法的独一,只是在如今的数据迷信范畴最受欢送且相关的一种而已。