选自BAIR

机器之心编译

参与:刘天赐、晓坤

由于机器学习零碎容易遭到历史数据引入的成见而招致歧视性行为,人们以为有必要在某些使用场景中用公道性原则约束零碎的行为,并等待其能维护弱势群体和带来临时收益。近日,伯克利 AI 研讨院宣布博客,讨论了静态公道性原则的临时影响,发现后果和人们的希冀相差甚远。相关论文已被 ICML 2018 大会接纳。

以「最小化预测误差」为目的训练的机器学习零碎通常会基于种族、性别等敏感特性(sensitive characteristics),表现出歧视性行为(discriminatory behavior),数据中的历史性偏向能够是其中的一个缘由。持久以来,在诸多如存款、雇用、刑事司法以及广告等使用场景中,机器学习不断被诟病「由于历史缘由,潜在地损伤到曾被无视的、弱势群体」。

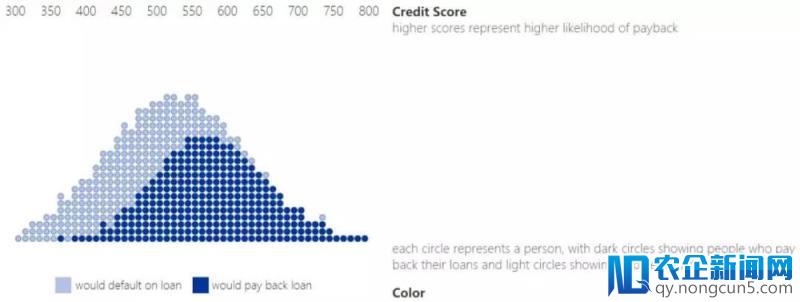

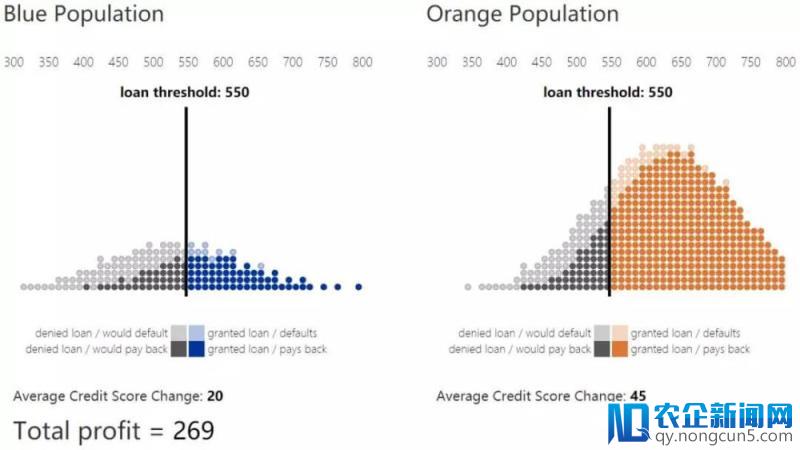

本文讨论了研讨者们在调整以临时社会福利(long term social welfare)为目的的机器学习所得决策方面的近期效果。通常,机器学习模型发生一个得分(score)来概述关于集体的信息,进而对其作出决策。例如,信誉得分(credit score)总结了某人的信誉历史和财务行为,来协助银行评定其信誉等级。我们以此存款场景为例贯串全文。任何用户群体在信誉得分上都有其特定散布,如下图所示。

1. 信誉得分和归还散布

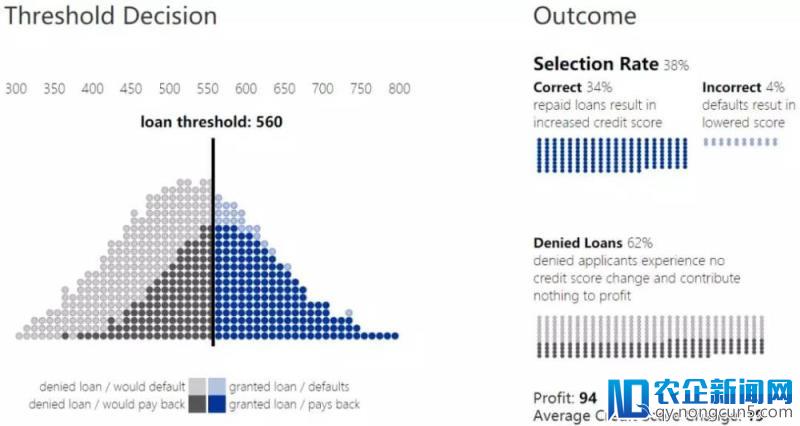

经过定义一个阈值,可以将得分转变为决策。例如,得分高于放贷阈值的人可以取得存款,而低于放贷阈值的则被回绝。这种决策规则叫阈值战略(threshold policy)。可以将得分了解为存款违约的估量概率编码。例如,信誉得分为 650 的人中,90% 的人会归还其存款。因而,银行可以预估其为信誉得分为 650 的用户提供等额存款的希冀收益,异样,可以预测为信誉得分高于 650(或任何给定阈值)的全体用户提供存款的希冀收益。

2. 存款阈值和后果

不思索其他要素的状况下,银行会试图最大化其总收益。收益取决于发出的归还存款额与在存款违约的损失额之间的比。在上图中,收益损失比为 1:-4,由于相较于收益,损失的本钱更高,因而银行会更保守的停止放贷,并进步放贷阈值。我们将高于此阈值以上的总体人数占比称为选择率(selection rate)。

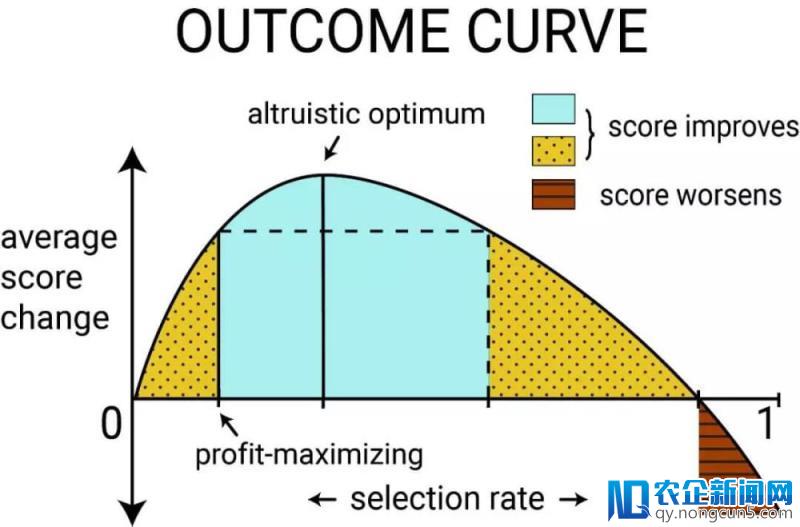

后果曲线

存款决策不只影响银行机构,也会影响团体。一次违约行为(存款人无法归还存款)中,不只是银行损失了收益,存款人的信誉得分也会降低。而成功的存款履约行为中,银行取得收益,同时存款人的信誉得分提升。在本例中,某用户信誉得分变化比为 1(履约):-2(违约)

在阈值战略中,后果(outcome)被定义为某群体得分的变化希冀,可以参数化为选择率的函数,称此函数为后果曲线(outcome curve)。当某群体的选择率发作变化时,其后果也会发作变化。这些总体人数级别上的后果会同时取决于归还概率(由得分编码失掉)、本钱以及集体存款决策的收益。

上图展现了某典型群体的后果曲线。当群体内取得存款并成功归还的集体足够多时,其均匀信誉得分就能够添加。这时,假如其均匀得分变化(average score change)为正,则可失掉无约束收益最大化后果。偏离收益最大化,以给更多人提供存款时,均匀得分变化会增大到最大值。称其为利他最优(altruistic optimum)。也可以将选择率提升到某个值,使均匀得分变化低于无约束收益最大化时的均匀得分变化、但仍然为正,即图中黄色点状暗影所表示的区域。称此区域中的选择率招致了绝对损害(relative harm)。但假如无法归还存款的用户过多,则均匀得分就会降低(均匀得分变化为负),从而进入白色横线暗影区域。

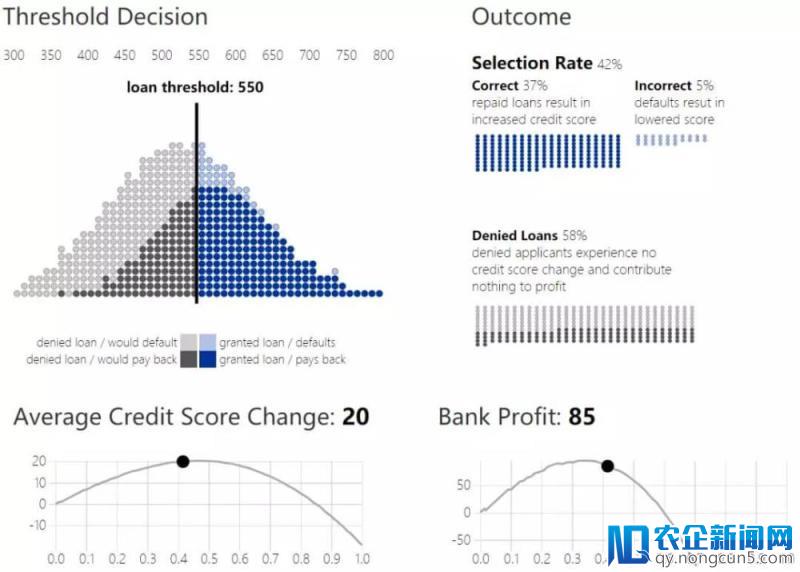

4. 存款阈值和后果曲线

多群体状况

给定的阈值战略如何影响不同群体中的集体?两个拥有不同信誉得分散布(credit score distribution)的群领会拥有不同的后果。

假定第二个群体和第一个群体的信誉得分散布不同,同时群体内人数也更少,将其了解为历史弱势群体。将其表示为蓝群体,我们希望保证银行的存款政策不会不合理地损伤、诈骗到他们。

假定银行可以对每个群体选择不同的阈值,虽然这能够面临法律应战,但为了预防由于固定阈值决策能够带来的差异后果,基于群体的阈值是无法防止的。

5. 不同群体的存款决策

很自然的会呈现成绩:怎样的阈值选择可以在蓝群体的得分散布中失掉希冀改善。如上文所述,无约束的银行战略会最大化收益,并选取收支均衡、存款有利可图的点。现实上,收益最大化阈值(信誉得分为 580)在两个群体中是相反的。

公道性原则

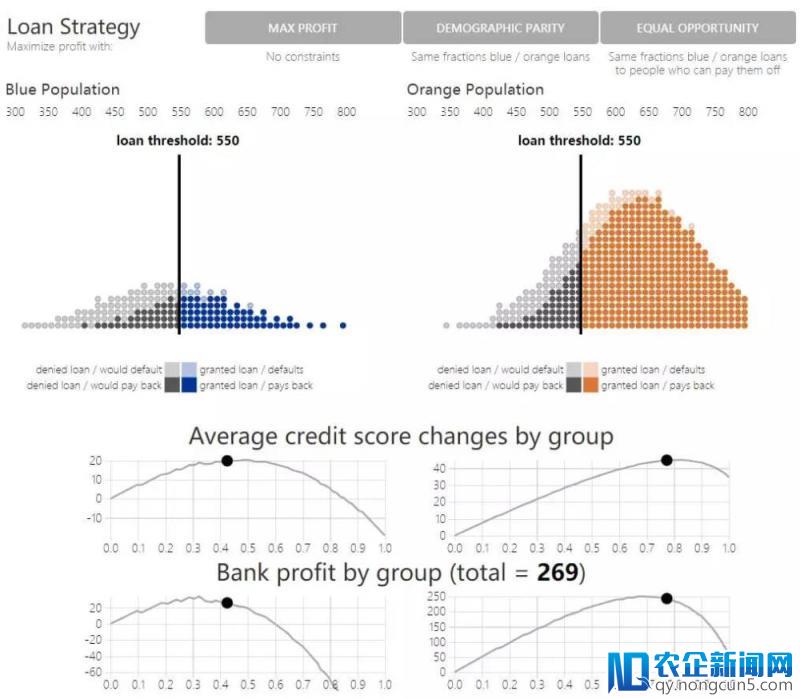

拥有不同得分散布的群领会有不同外形的得分曲线(原文图 6 上半局部展现了真实信誉得分数据和一个复杂后果模型的后果曲线)。作为无约束收益最大化的另一个替代选择是公道性约束(fairness constraints):经过某些目的函数令不同群体的决策对等。目前曾经提出了各种公道性原则,诉诸直觉来维护弱势群体。经过后果模型,我们可以正式的答复:公道性约束能否真的鼓舞了更多的积极后果。

一个罕见的公道性原则,人口统计对等(demographic parity),要求银行在两个群体中给出相反比例的存款。在此要求下,银行持续尽能够最大化收益。另一个原则,时机对等(equality of opportunity):两个群体中的真阳性率(true positive rate)相等,要求银行对两个群体中会归还存款的集体相反的存款比例。

虽然从要求静态决策公道的角度动身,这些原则都很合理,但它们大多疏忽了这些对群体后果的将来效应。原文图 6 经过比照最大化收益、人口统计对等和时机对等下的战略后果,展现了这一点。看看每个存款战略下银行收益和信誉得分的变化。和最大化收益战略相比,人口统计对等和时机对等都降低了银行收益,但能否取得了相较于最大化收益失掉提升的蓝群体后果?虽然相较于利他最优,最大化收益战略对蓝群体存款过低,但时机对等战略则(相较于利他最优)存款过多,人口统计对等则存款过多,并到达了绝对损害区域。

6. 有约束条件下的存款决策模仿

假如公道性原则的目的是「从临时来看,提升或公道化一切群体的幸福」,方才展现的则标明在某些场景下,公道性原则实践上是违犯了这一目的。换言之,公道性约束会进一步降低弱势群体中的现有福利。树立精确模型,以预测战略将对群体后果发生的效应影响,也答应以缓解由于引入公道性约束而发生的预料以外的损伤。

对「公道」机器学习后果的考虑

研讨者提出了一个基于临时后果的对机器学习「公道性」讨论的视角。假如没有细致的延迟后果模型,就不能来预测公道性原则作为加在分类零碎上之后的影响。但是,假如有精确的后果模型,就能以相较于现有公道性原则而言,更直接的方式来优化正例后果。详细而言,后果曲线给出了偏离最大化收益战略,以最直接提升后果的办法。

后果模型是在分类进程中引入范畴知识的一个详细办法,并能与许多指出机器学习中的「公道」具有背景敏感特性的研讨很好地吻合。后果曲线为此使用特定的权衡进程提供了一个可解释的视觉工具。

更多细节请阅读论文原文,本文将在往年 35 届 ICML 大会上呈现。本研讨只是对「后果模型可以缓解机器学习算法对社会预料外影响」的初步探究。研讨者们置信,将来,随着机器学习算法会影响到更多人的生活,会有更多的研讨任务,来保证这些算法的临时公道性。

- 论文:Delayed Impact of Fair Machine Learning

- 论文地址:https://arxiv.org/pdf/1803.04383.pdf

原文链接:http://bair.berkeley.edu/blog/2018/05/17/delayed-impact/