雷锋网 AI 科技评论按:往年 CVPR 2018 最佳论文《Taskonomy: Disentangling Task Transfer Learning》(义务学:义务迁移学习的解耦)研讨了一个十分新颖的课题,那就是研讨视觉义务之间的关系,依据得出的关系可以协助在不同义务之间做迁移学习。相比于我们看惯了的为各种义务刷分的研讨,这篇论文可谓是一股计算机视觉范畴的春风。

CVPR 2018 时期雷锋网 AI 科技评论作为独一注册媒体停止现场报道,也参与倾听了这篇论文的现场演讲。演讲者为论文第一作者 Amir R. Zamir,他是斯坦福和 UC 伯克利大学的博士后研讨员。当他还博士在读时也凭仗论文《Structural-RNN: Deep Learning on Spatio-Temporal Graphs》( http://arxiv.org/abs/1511.05298 )取得了 CVPR 2016 的最佳先生论文奖。

以下为演讲听译图文全文。

Amir R. Zamir:大家早上好,我引见一下我们的论文《Taskonomy: Disentangling Task Transfer Learning》,这篇论文是我与 Alexander Sax、William Shen、Leonidas Guibas、Jitendra Malik 以及 Silvio Savarese 共同完成的。

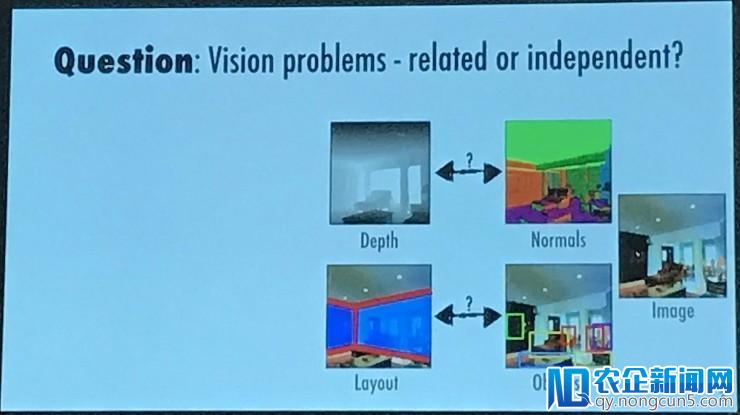

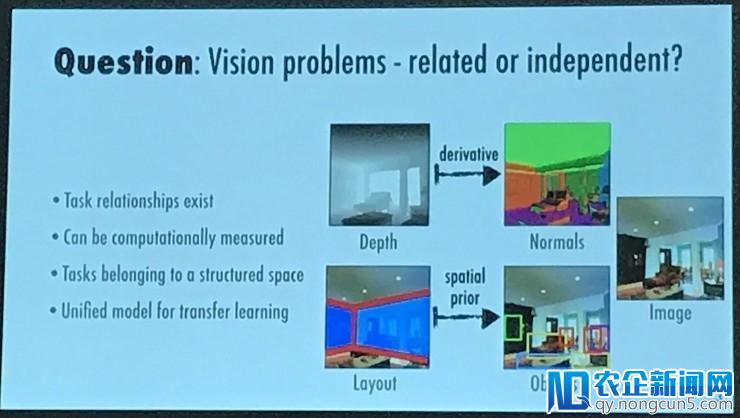

我们首先提出了一个成绩,视觉义务之间有什么关系吗?还是说它们都是各自独立的。比方深度估量和外表法线预测之间,或许对象辨认以及室内规划辨认之间,有没有什么关系。我们觉得答案是一定的,不论是从我们的直觉上还是借助一些知识。比方我们晓得外表法线预测模型、深度预测模型或许室内规划模型都可以为物体辨认带来不小的协助。所以义务之间一定是有一些关系的。

那么这些关系有哪些影响?它们又会有什么重要作用呢?这就是我明天要讲给大家的。

我要引见这四个要点:

-

义务之间的关系是存在的

-

这些关系可以经过计算性的方式失掉,不需求我们作为人类的知识参与

-

各种义务属于一个有构造的空间,而不是一些各自独立的概念

-

它可以为我们提供一个用于迁移学习的一致化的模型

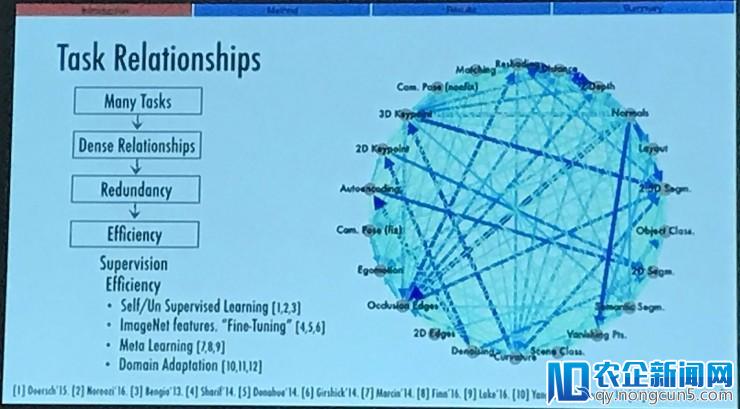

方才我展现的例子只是许多视觉义务中的几种。任选一些义务出来我们都可以问这样的成绩:它们之间有没有关系、有多大关系。为了答复这些成绩,我们要对义务之间的关系、义务之间的冗余有一个全局的看法,我们需求把义务作为一个个人来对待,而不是作为单个单个的义务。我们应用它们之间的关系和冗余度到达更高的效率。

其中有一个十分令人感兴味的值得进步效率的方面就是监视的效率,就是我们希望用更少的标注数据来处理成绩,我们这项研讨的关注点也就在这里。许许多多的研讨论文都讨论了如何增加模型对标注数据的需求,如今也有自我监视学习、无监视学习、元学习、义务适配等办法,以及在 ImageNet 上学到的特征根底上做精密调理,如今这都曾经成了一种习用做法了。

实践上,迁移学习之所以可行就是由于义务间的这些关系。从高笼统层次上讲,假如可以迁移或许翻译一个模型学到的外部形态,这就有能够会对学习处理别的义务起到协助 —— 假如这两个义务之间存在某种关系的话。上面我详细讲讲这局部。

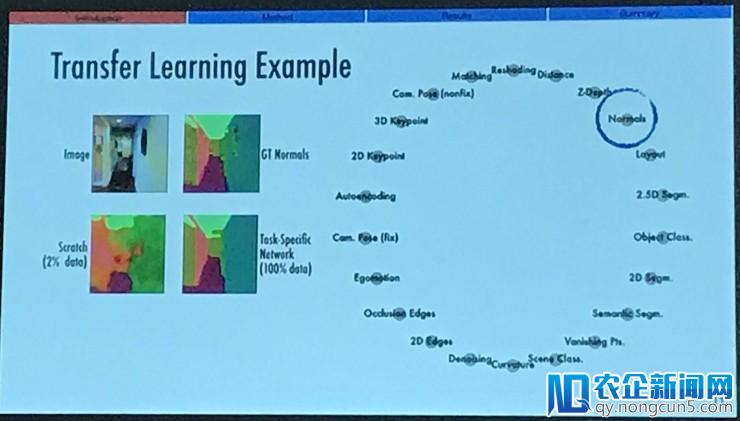

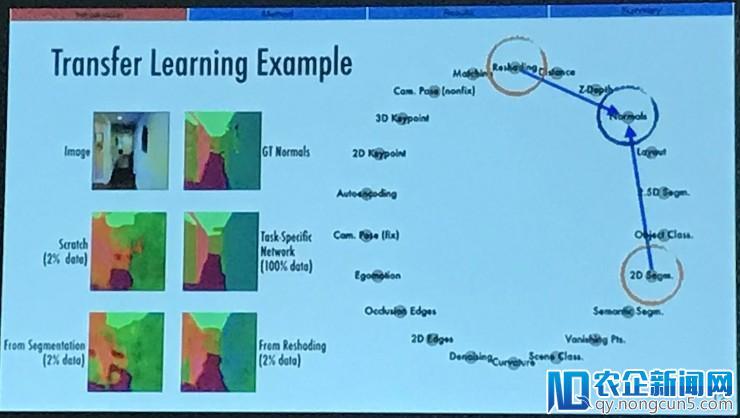

以外表法线预测义务(surface normal)为例,我们专门训练一个神经网络预测图像中的立体的法线,显然效果是不错的。假如我们只用 2% 的训练数据训练网络,就会失掉左下角这样的后果,显然我们都能猜到后果会很蹩脚。

然后我们从两个其它的义务,图像重整(reshading)以及图像联系(segmentation)的模型做迁移。迁移的时分都是在一个小的复制网络上用方才异样的 2% 的数据做训练。

可以看到,图像联系模型迁移后的表现并不好,但是图像重整模型的外表法线预测表现就不错。这就标明了,图像重整和外表法线预测之间的关系要比图像联系与外表法线预测之间的关系更强、更严密。直觉上这还挺合理的,我们会觉得对场景做重整的时分就是会与立体的法线有不少联络;相比之下法线预测与图像联系之间,我就想不到会有什么关系,也能够是真的没有什么关系吧。所以我们察看到,关于相互之间有关系的义务,我们只需求一点点额定的信息就可以协助一个义务的模型处理另一个义务。

假如你能有一些办法,把少量恣意给定的义务之间的关系停止量化,我们就可以失掉一个完好的图构造。这就是我们等待的那种可以了解不同义务之间的冗余度的一个全局窗口。比方它可以应用我们后面提到的义务之间的冗余度处理一系列监视学习义务,可以只用一点点资源就把旧义务迁移到新义务上;或许处理一个全新的义务,我们简直没有这个义务所需的标注数据。那么如今学习处理新义务就变成了向原有的构造中添加一些内容,而无需从零开端。

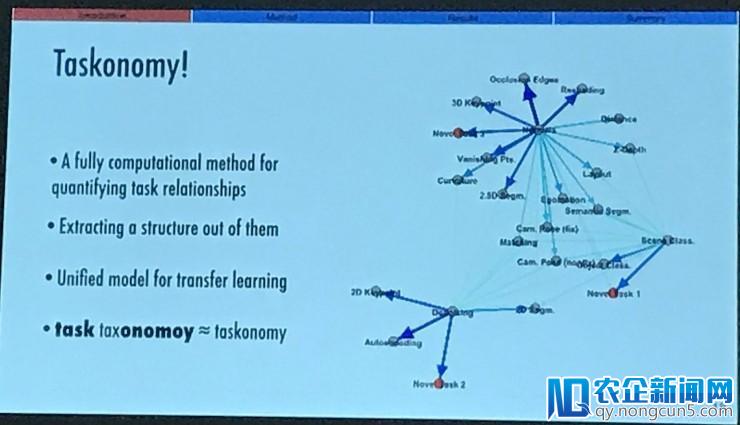

这就是我们的「Taskonomy」的目的,这是一种完全计算化的办法,可以量化计算少量义务之间的关系,从它们之间提出一致的构造,并把它作为迁移学习的模型。我们把它称作「Taskonomy」,也就是 task 义务 和 taxonomony 分类学 两个词的组合,就是意味着要学到一个分类学角度动身的迁移战略。

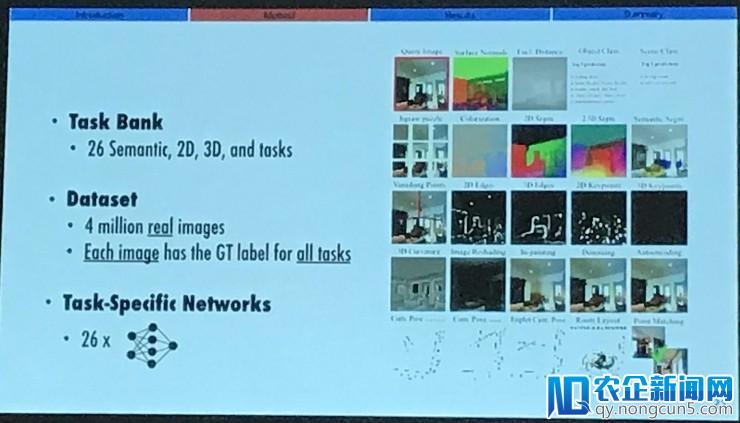

我们详细是这样做的。首先我们找到了一组一共 26 个义务,包括语义、 2D、2.5D、3D 义务。我们并没有细致片面地选择更多的各种视觉义务,这些只是我们演示办法用的一组样本;稍后我还会再谈到参与计算的义务列表的选择。我们搜集了大约 400 万张室内物品的照片,然后每一张照片都为这全部 26 种义务做了预备。这些图像全部都是真实的,不是生成的;关于 3D 视觉义务,我们用构造光传感器扫描出了相应的室内场景构造,这样我们也可以更容易地为这些义务取得真实值。

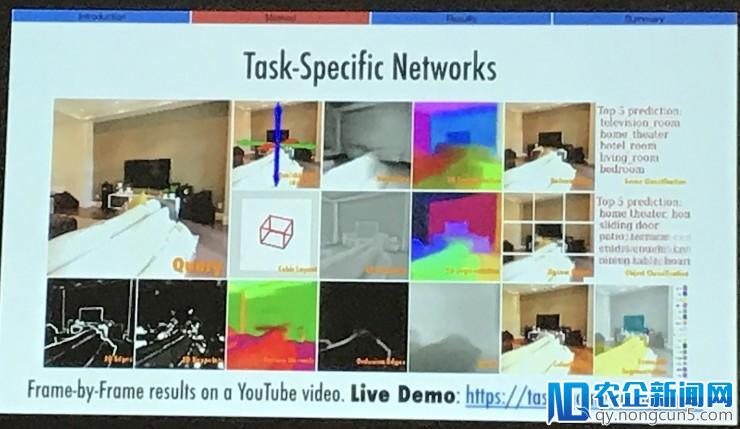

接上去我们为义务列表里的这 26 个义务辨别训练了 26 个义务公用神经网络,这些画面就是这 26 个义务的输入。3D 义务比方曲率预测,语意义务比方物体辨认;也有一些义务是自监视的,比方着色。

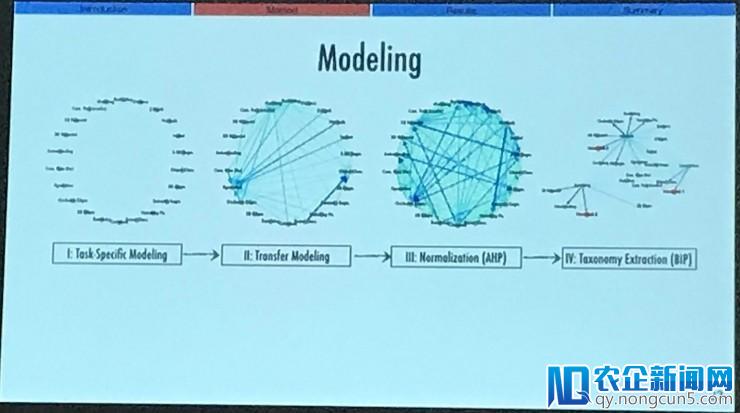

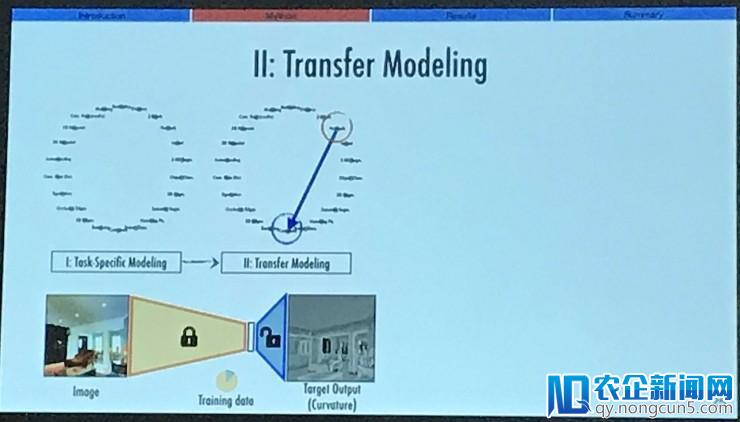

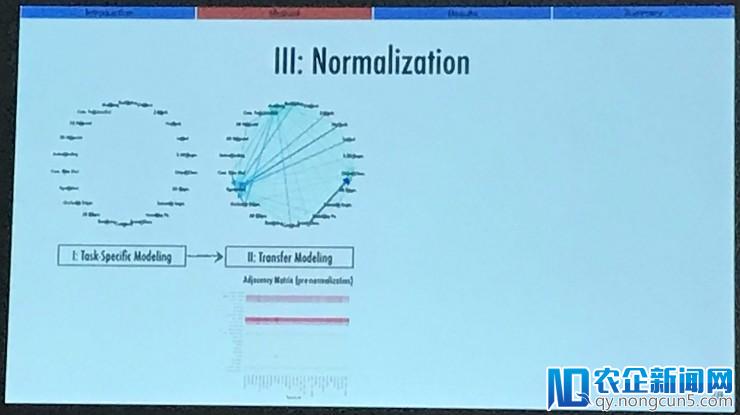

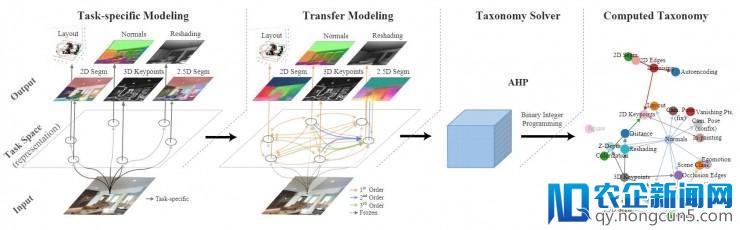

我们的义务学模型有四个次要步骤,第一步就是训练这 26 个义务公用网络,然后把权值锁定上去;这时分每一个义务就都有一个专门为了它训练的神经网络。

下一步是量化不同义务之间的关系。比方以计算法线估量和曲率估量之间的关系为例,我们用锁定了权值的法线估量模型训练一个小的复制模型,这个小模型从法线估量模型的表征中尝试计算曲率。然后我们就用新的测试数据评价小模型的表现。这个表现就是评价详细这两个义务之间的直接迁移关系的根据。

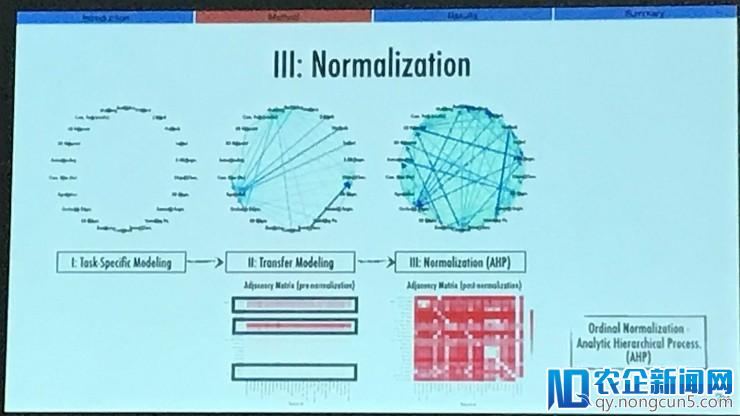

那么,含有 26 个义务的清单,一共有 26 x 25 中组合方式,我们把它们全都做了这样的训练和评价。这样就失掉了我们想要的完好的义务关系图构造。不过,节点之间的值还需求规范化,由于这些义务都是属于各自不同的输入空间的,也有不同的数学性质。关于关系的描绘,我们求了这样的整个图构造的邻接矩阵(adjacency matrix),从计算后果可以分明看到其中有一些东西在矩阵中起到了决议性的作用。缘由就是由于这些对于互联网金融P2P企业来说,支付市场完善的标准和管理系统将彻底改变互联网金融行业的格局,不仅给从业者提供了的巨大的发展机遇,也带来了全新的挑战。义务存在于不同的输入空间中,我们需求做规范化。

我们对矩阵做规范化的办法是一种名为剖析性层次进程(Analytic Hiererchical Proess)的序数办法。在这里我就不详细引见了,不过复杂来说,我们选取了一种序数的形式,由于相比其他的一些剖析办法,它对输入空间的数学性质做出的假定对我们来说十分关键。详细内容可以参见我们的论文。

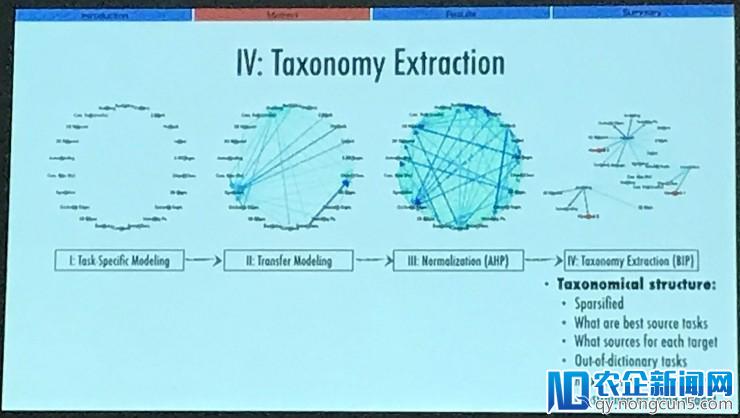

那么, 这个完好的关系图构造曾经是完全量化了的,针对一对一对的义务之间,它的取值就是义务迁移的依赖水平。值得留意的是,并不是恣意两个义务之间的迁移都有用,有很多义务之间的关系都很弱。但是当然有一些很强的关系,而且有一些分明的形式。

我们就希望从完好的图构造中提取出这种稀疏的关系。对我们来说,提取出的构造能协助我们最大化原先义务的表现,并且通知我们如何为新义务选择一个最好的源义务、哪个源义务可以迁移到尽能够多的义务中,以及如何迁移到一个义务清单中不包括的新义务上去。

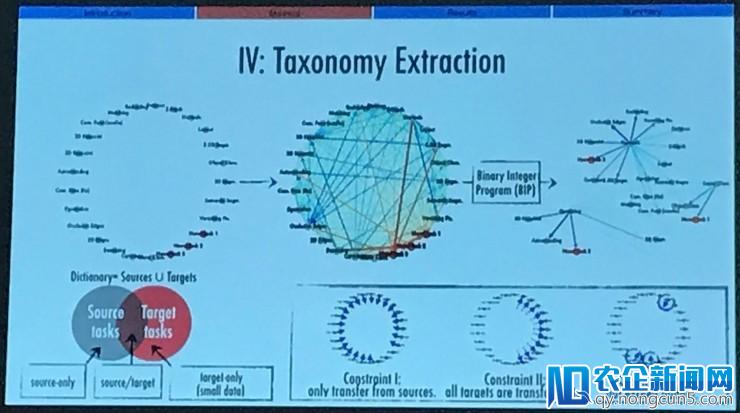

在这一步中我们做的复杂来说可以方式化为一个子图选择成绩。我们曾经定义好了义务清单,之前曾经见过的义务用灰色的节点表示,未见过的新义务用白色的节点表示。然后我们设定一些限制,用二进制抽取的方式计算失掉最优的子图。计算细节可以看我们的论文或许海报,还挺复杂直接的。

子图抽获得到的后果就给我们提供了想要处理每一个义务所需的衔接性,包括全新的义务,如何运用无限的资源、不超越用户定义限制的资源来最大化各个义务的表现,而用户定义的资源的数量实践上也决议了源义务的义务清单可以有多大。这也就是我们的目的。

(雷锋网 (大众号:雷锋网) AI 科技评论注:论文中有另一张全进程表示图如下)

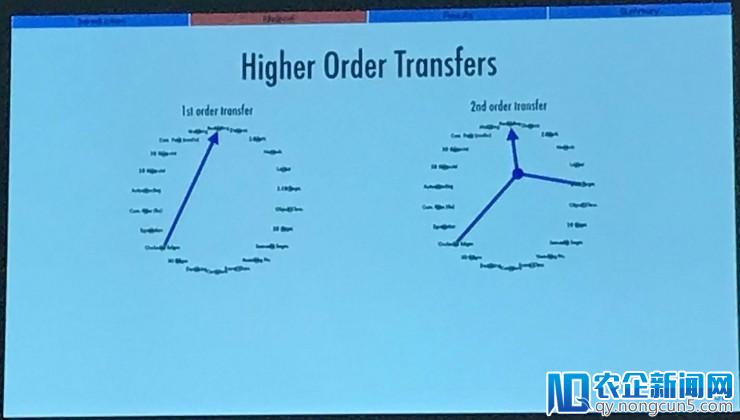

还有一点我没有工夫展开讲的是高阶义务迁移,就是 2 个甚至更多的义务可以一同作为源义务和资源开支,在我们的框架内停止计算。那么实践上我们的邻接矩阵也就远大于 26 x 25 ,由于还有多对一的状况。

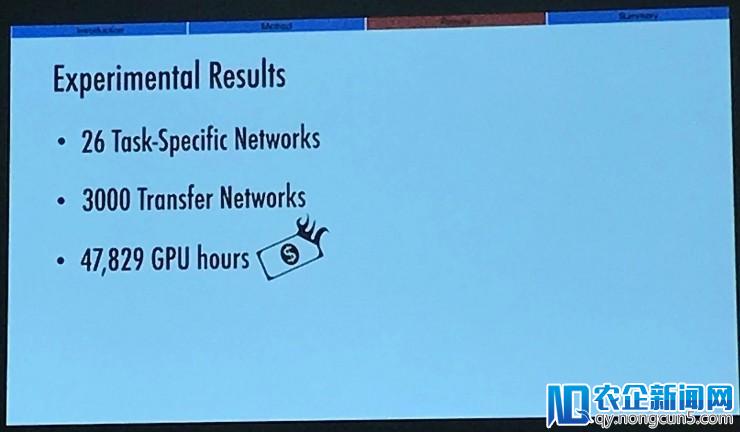

上面说一下实验后果。关于 26 个义务的义务清单,一共有 3000 个义务迁移网络,破费了 47829 小时的 GPU 工夫。训练模型大约花了我们 4.7 万美元。训练迁移后的模型只用了 1% 的义务公用网络的训练数据。

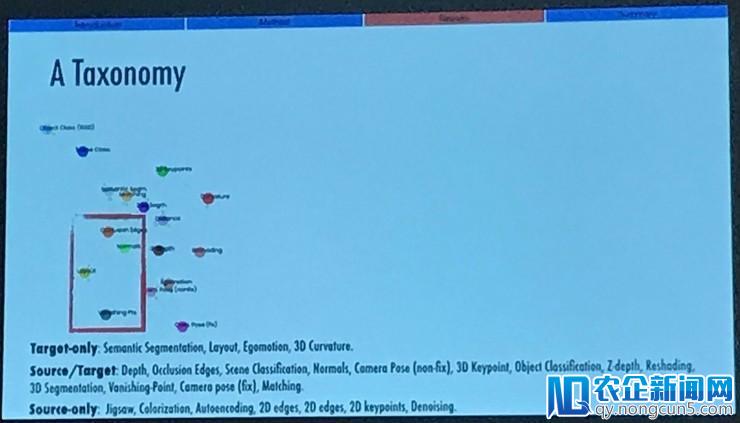

这是一个义务分类后果的例子。这个例子中包括的是我后面说的这 26 个义务,其中有 4 个是作为目的的义务,也就是说它们只要十分少的数据,这些数据刚刚够训练复制的迁移网络,而无法从零训练一个新的网络。检查一下这几个义务的衔接性就会直觉上觉得是那么回事,3D 义务和其它的 3D 义务之间有更强的联络,以及和 2D 义务的类似度很低。

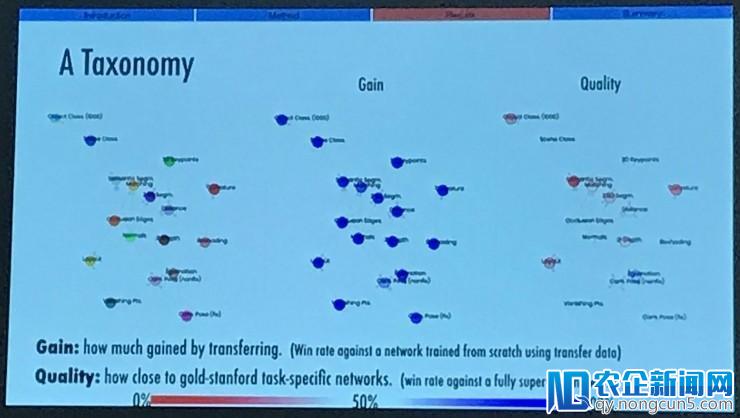

为了评价我们的迁移战略的效果,我们提出了两个评价目标,增益 Gain 以及质量 Quality。增益是指迁移的网络的表现相比用异样的大批数据从零训练的表现的胜率;图中越深的蓝色表示越高的胜率,也就是说迁移的效果总是要更好。质量是指迁移的网络相比用全部数据训练的义务公用网络的胜率,我们可以看到许多状况下都是白色,就是说这些迁移后的模型的表现曾经和作为黄金规范的义务公用网络的表现差不多好了。

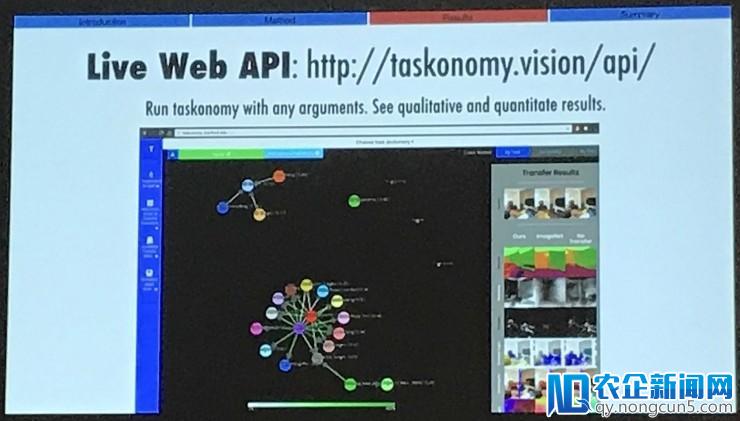

这只是一个分类学的例子,大家可以编写本人的完成,不过最好的办法还是试一试我们的在线实时 API, taskonomy.vision/api,你可以本人设定想要的参数,检查义务分类学的定性以及定量的计算后果。值得一提的是,我们的分类学后果很合适配合 ImageNet 的特征运用,由于它也是目前最常用的特征了。我们也做了一些和 ImageNet 相关的实验,欢送大家看我们的论文。

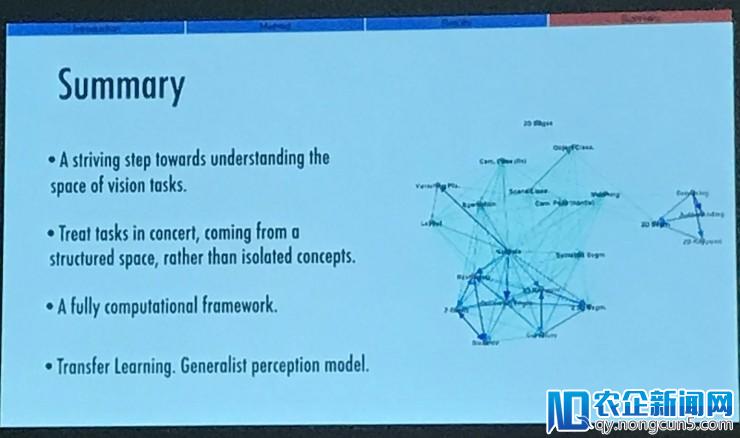

最初总结一下:

-

我们向着看法视觉义务空间的目的迈出了积极的一步;

-

我们把义务作为一个构造化空间中的群体,而不是作为单个单个的概念来对待;这里这张图就是依据量化的关系绘制的。

-

这是一个完全可计算化的框架;

-

它可以协助我们做迁移学习,也可以协助我们寻觅通用化的感知模型。

拜访我们的网站 http://taskonomy.stanford.edu/ 的话还可以看到一个 YouTube 的引见视频。谢谢!

(完)

实践上 http://taskonomy.stanford.edu/ 网站上有丰厚的研讨引见以及资源,实时演示 demo、用于定制化义务计算的 API、迁移进程的可视化、预训练模型、数据集下载等一应俱全。同作者所说一样,希望理解更多信息的可以阅读论文原文以及拜访他们的网站。

论文地址: http://taskonomy.stanford.edu/taskonomy_CVPR2018.pdf

雷锋网 AI 科技评论报道。更多 AI 学术内容请持续关注我们。

。